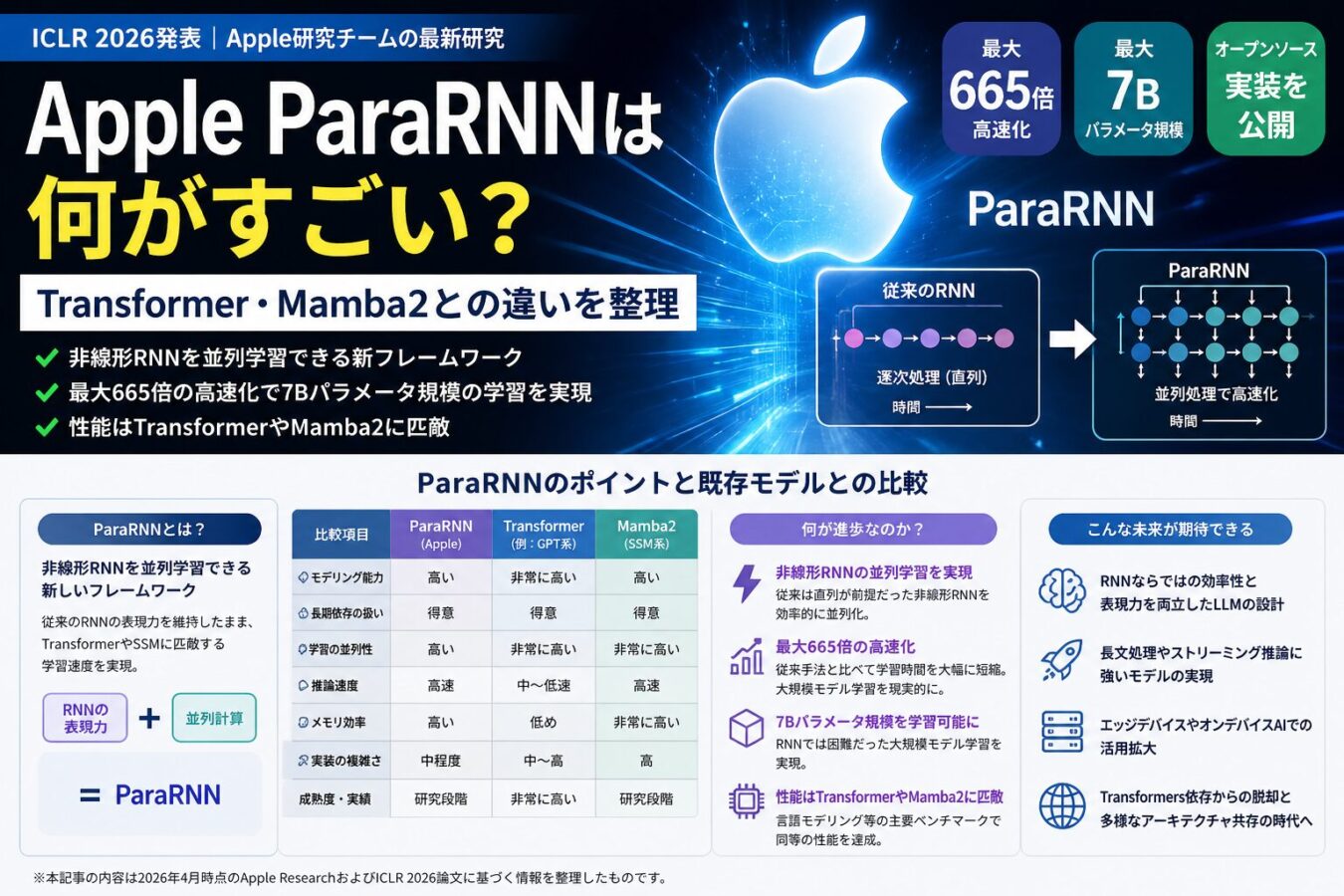

Apple ParaRNNは、RNNの弱点だった「系列方向に並列学習しにくい」という課題に踏み込んだApple研究チームの新しいフレームワークです。最大665倍の高速化や7Bパラメータ規模のRNN学習が示され、TransformerやMamba2と並ぶ選択肢になり得るのかが注目されています。本記事では、何が新しいのか、既存手法とどう違うのか、実務導入でどこまで期待してよいのかを整理します。

導入:ParaRNNは「RNNをもう一度LLM候補に戻す」研究

ParaRNNは、AppleのMachine Learning Researchで紹介された、非線形RNNを系列方向に並列学習するためのフレームワークです。ポイントは、RNNそのものを捨てるのではなく、従来のLSTMやGRUが抱えていた学習時の逐次処理ボトルネックを別の数値計算の問題として解き直している点にあります。

結論から言えば、ParaRNNはすぐにChatGPTやSiriのような完成済みLLMを置き換える製品ではありません。現時点では研究成果とオープンソース実装という位置づけです。ただし、長い文脈を扱うモデルや、推論時のメモリ効率が重要な用途では、Transformer一辺倒ではない設計を検討する材料になります。

Appleの公式解説では、ParaRNNにより、適応版のGRUとLSTMであるParaGRU、ParaLSTMを使い、7Bパラメータ規模のRNNを学習し、TransformerやMamba2と比較可能な言語モデリング性能を示したと説明されています。詳細はAppleのResearch Highlightと論文紹介ページで確認できます。

何が発表されたのか:最大665倍高速化と7B規模RNNの学習

Apple研究チームの論文「ParaRNN: Unlocking Parallel Training of Nonlinear RNNs for Large Language Models」は、OpenReviewではICLR 2026 Oralとして掲載されています。OpenReview上の情報では、公開日は2026年1月26日、最終更新日は2026年4月11日です。Appleは2026年4月のICLR 2026関連発表でも、この研究を大きく取り上げています。

発表の中心は、非線形RNNの系列計算を、時間ステップごとに1つずつ進めるのではなく、系列全体の隠れ状態を同時に求める方程式系として扱う点です。その方程式をNewton法で線形化し、並列リダクションを組み合わせて解くことで、RNNの学習時にも系列方向の並列処理を可能にします。

Appleは、ナイーブな逐次適用と比べて最大665倍の高速化を達成したと説明しています。ただし、この数値は「RNNセル適用の逐次処理」との比較であり、LLMの学習全体が常に665倍になるという意味ではありません。実際の学習速度は、モデル構造、系列長、GPU、CUDAカーネル、データパイプライン、分散学習設定に左右されます。

また、AppleはParaRNNのコードをGitHubリポジトリで公開しています。READMEでは、PyTorch、CUDA対応環境、C++コンパイラ、CUDA toolkitが必要とされており、加速モードを使うにはGPU環境が前提になります。研究を試す入口はありますが、一般的なアプリ開発者がすぐに本番導入できる段階とは分けて考えるべきです。

背景:なぜRNNはTransformerに主役を譲ったのか

RNNは、系列データを1ステップずつ読みながら隠れ状態を更新するモデルです。テキスト、音声、時系列データの処理で長く使われてきました。推論時には、過去の情報をコンパクトな状態として保持できるため、新しいトークンを生成するときに全履歴へ毎回注意を向ける必要がありません。この性質は、長い文脈やストリーミング処理では魅力的です。

一方で、学習時には大きな弱点があります。RNNは基本的に、前の時刻の隠れ状態が決まらないと次の時刻を計算できません。つまり、系列長が長くなるほど逐次処理が増え、GPUの並列計算能力を活かしにくくなります。大規模化に向いたTransformerが広がった背景には、この学習並列性の差がありました。

Transformerは、2017年の論文Attention Is All You Needで提案された、自己注意機構を中心とするアーキテクチャです。系列内のトークン同士の関係を並列に計算しやすく、大規模データとGPUを使った事前学習に適していたため、現在のLLMの主流になりました。

ただし、Transformerにも課題があります。自己注意は文脈長が伸びるほど計算量とメモリ消費が大きくなりやすく、推論時に長い履歴を扱うほど負荷が増えます。そのため、近年はMambaのような状態空間モデル、線形Attention、畳み込み系モデル、そしてRNNの再評価が進んでいます。

ParaRNNで何ができるようになるのか

ParaRNNが示した進歩は、「RNNは推論では効率的だが、大規模学習には向かない」という従来の見方を一部崩したことです。Appleの説明では、ParaRNNは非線形RNNの系列関係を1つの方程式系として定式化し、Newton反復と並列リダクションによって、系列全体の隠れ状態を効率的に求めます。

これにより、従来のRNNでは難しかった大規模言語モデル級の学習実験が現実的になります。論文では、ParaGRUとParaLSTMを使って400Mから7Bパラメータ規模のモデルを学習し、7B規模ではTransformerやMamba2に近いPerplexityや下流タスク性能を示したとされています。

もう1つ重要なのは、非線形性を残せる点です。MambaなどのSSM系モデルは、並列化しやすい線形再帰を活用することで効率化してきました。これに対し、ParaRNNは非線形RNNの表現力を保ちながら、学習時の並列化を狙います。Appleの実験では、状態追跡や検索を必要とする合成タスクで、ParaGRUとParaLSTMが線形モデルより高い結果を示したと説明されています。

想定されるユースケースは、長文生成、ストリーミング推論、音声・センサー・ログのような連続データ処理、エッジやオンデバイスAIに近い省メモリ推論です。ただし、現時点でAppleが一般向けAPIや製品機能として提供しているわけではありません。実用化の価値は、今後の再現実験、実装成熟度、既存LLM基盤との統合次第です。

既存競合との比較:Transformer・Mamba2・従来RNNと何が違うのか

ParaRNNを理解するには、単に「RNNが速くなった」と見るより、Transformer、Mamba2、従来のLSTM/GRUと比較するのが分かりやすいです。以下の表では、性能、計算効率、用途、導入しやすさ、制限という観点で整理します。

| 比較軸 | ParaRNN | Transformer | Mamba2 | 従来LSTM/GRU |

|---|---|---|---|---|

| 基本思想 | 非線形RNNを方程式系として並列に解く | 自己注意で系列内の関係を並列処理する | 状態空間モデルを効率的に計算する | 隠れ状態を時間順に更新する |

| 学習時の並列性 | 系列方向の並列化を狙える | 非常に高い | 高い | 低い |

| 推論時の効率 | RNNの性質により長文で有利になり得る | 文脈が長いほど負荷が増えやすい | 長文推論で有利になりやすい | 軽量だが大規模性能で不利だった |

| 表現力 | 非線形再帰を扱える点が特徴 | 実績が最も豊富で汎用性が高い | 効率と性能のバランスが強み | 小中規模では有用だが大規模化が難しかった |

| 導入しやすさ | 研究段階。CUDAやカスタムカーネル前提 | ライブラリ、モデル、運用知見が豊富 | 実装は増えているがTransformerほど成熟していない | 実装は容易だが最新LLM用途では選びにくい |

| 向くケース | 長文・省メモリ推論・新アーキテクチャ研究 | 汎用LLM、マルチモーダル、既存基盤活用 | 長文処理、効率重視、SSM研究 | 小規模時系列、組み込み、単純な逐次データ |

Transformerとの違いは、長い文脈を扱うときの推論コストにあります。Transformerは自己注意により高い表現力と学習並列性を持つ一方、文脈長が伸びると計算やメモリが増えやすくなります。ParaRNNは、学習時の弱点を緩和しつつ、RNN由来の推論効率を活かす方向です。

Mamba2との違いは、再帰の扱い方です。Mamba2はStructured State Space Dualityに基づくSSM系アーキテクチャで、効率的な長系列処理を目指します。ParaRNNは、線形性に寄せるのではなく、非線形RNNをNewton法で扱うことで、表現力と並列性の両立を狙います。

従来RNNとの違いは、学習のスケールです。通常のLSTMやGRUは、系列を順番に展開するため、巨大モデルの学習では不利でした。ParaRNNはParaGRU、ParaLSTMのようにヤコビアンが構造化されるセル設計とCUDAカーネルを組み合わせ、大規模学習を可能にする方向へ設計されています。

公平に見ると、現時点で最も実務利用しやすいのはTransformerです。モデル、推論サーバー、量子化、監視、評価、RAGとの統合などの周辺エコシステムが非常に厚いからです。一方、ParaRNNは、将来の高効率LLM設計を研究するチームにとって、検証する価値のある新しい候補と言えます。

懸念点・注意点:研究成果として読むべき理由

ParaRNNには大きな可能性がありますが、すぐに本番導入できる成熟技術として扱うのは早計です。第一に、発表されている性能は特定条件での研究実験に基づくものです。最大665倍という数字は非常に印象的ですが、比較対象はナイーブな逐次処理であり、実務の分散学習パイプライン全体の高速化率とは一致しません。

第二に、実装面の制約があります。GitHubのREADMEでは、ParaRNNはPython 3.9以上、PyTorch、CUDA対応環境、CUDA拡張のビルドを前提としています。Appleの研究でありながら、現時点の公開実装はApple Silicon上で簡単に動くオンデバイス向けSDKという位置づけではありません。

第三に、セル設計に工夫が必要です。Appleの解説では、汎用RNNのヤコビアンが密行列になると保存コストや行列積コストが大きくなり、実用的ではないと説明されています。そのためParaGRUでは対角構造、ParaLSTMではブロック対角構造になるよう設計されています。任意のRNNセルをそのまま高速化できると考えるべきではありません。

第四に、Newton反復の収束性と数値誤差です。Appleは実験で3回程度の反復で安定して収束したと説明していますが、これは設計されたセルと実験条件での結果です。GitHub READMEにも、数値近似に伴う誤差が系列長に応じて増える可能性が示されています。精度保証が重要な領域では、再現性評価が不可欠です。

最後に、安全性やガバナンスの問題は、ParaRNNだけでは解決しません。モデルアーキテクチャが効率化しても、学習データの権利、個人情報、幻覚、偏り、監査、ログ管理、モデル更新時の回帰テストといった運用課題は残ります。ParaRNNは効率的な系列モデリングの研究であり、AI利用リスク全般を自動的に下げるものではありません。

導入メリットを得やすい人・組織

向いている人・組織

ParaRNNが最も刺さるのは、既存のTransformer基盤で長文推論コストやメモリ消費に課題を感じている研究チームです。たとえば、長いログ、会話履歴、センサーストリーム、音声系列、コード履歴などを扱い、推論時のレイテンシやGPUメモリを抑えたい組織には検証価値があります。

また、新しいLLMアーキテクチャを自社で評価できるML基盤チームにも向いています。CUDAカーネル、PyTorch拡張、分散学習、モデル評価ベンチマークを扱える体制があれば、ParaGRUやParaLSTMを既存のTransformer、Mamba系モデルと同条件で比較できます。

オンデバイスAIやエッジAIを長期的に見ている組織にも関係があります。RNN系モデルは推論時に過去文脈をコンパクトな状態として保持できるため、メモリ制約の強い環境で魅力があります。ただし、現時点の公開実装がそのままモバイル端末に載るという話ではなく、研究成果としての方向性に注目すべきです。

現時点では向いていない人・組織

一方、すぐに商用LLMを導入したいだけの企業には向きません。既存のAPI、RAG基盤、Fine-tuning、社内ナレッジ検索を整える段階なら、まずは実績あるTransformer系モデルやクラウドLLMを使い、業務要件、評価指標、ガバナンスを固めるほうが現実的です。

CUDA環境やカスタムカーネルの検証体制がないチームも慎重であるべきです。ParaRNNはREADME上、加速モードでCUDA対応環境を必要とします。インストール、ビルド、ベンチマーク、障害切り分けを担える人材がいなければ、研究コードの検証だけで多くの時間を使う可能性があります。

規制産業やミッションクリティカルな用途で、再現性、説明責任、モデル更新履歴、第三者監査が強く求められる場合も、現段階では本番採用を急ぐべきではありません。まずはオフライン実験で、同じデータ、同じ評価、同じコスト条件で既存手法との差を確認する必要があります。

実務導入を判断する際のポイント

まず確認したい前提条件

ParaRNNを検討する前に、自社の課題が本当に「長い系列を効率よく扱うこと」にあるのかを確認する必要があります。短い問い合わせ応答や一般的な文書検索では、ParaRNNの強みが出る前に、既存LLMやRAG設計で十分な場合があります。

次に、比較対象を明確にします。単にParaRNNを動かすのではなく、Transformer、Mamba2、従来RNN、場合によっては線形Attention系モデルを同じデータセット、同じ系列長、同じ推論条件で比較することが重要です。比較なしでは、速度やPerplexityの数字だけでは判断できません。

導入判断で見るべきポイント

第一に見るべきは精度です。Perplexityだけでなく、自社タスクでの正答率、要約品質、検索補助の有効性、長文内の参照保持、指示追従性を評価します。Appleの実験では下流タスク性能も示されていますが、自社データで同じ傾向が出るとは限りません。

第二は再現性です。Newton反復を使うため、数値誤差、系列長、精度形式、GPU種類、カーネル実装の違いが結果に影響する可能性があります。同じ設定で複数回実行して結果のばらつきが許容範囲に収まるかを確認する必要があります。

第三はコストです。ParaRNNの魅力は長文や推論時効率にありますが、学習環境の構築、CUDAカーネルの保守、評価パイプラインの整備、人材コストまで含めて見なければなりません。GPU時間だけでなく、研究開発チームの工数も含めた総コストで判断すべきです。

第四は既存システムとの接続性です。現場のLLM基盤は、ベクトル検索、監視、キャッシュ、権限管理、プロンプト管理、評価ダッシュボードと結びついています。ParaRNNを採用する場合、それらの運用基盤に組み込めるか、推論サーバーやモデル変換の手段があるかを確認します。

第五は代替手段です。長文処理が課題なら、コンテキスト圧縮、RAG、キャッシュ、KVキャッシュ最適化、Mamba系モデル、長文対応Transformerなど複数の選択肢があります。ParaRNNだけに絞らず、実装リスクと性能差を並べて検討するのが現実的です。

試験導入から本格導入までの見方

試験導入では、まず公開コードで短いベンチマークを再現し、READMEにあるSequential、Parallel、Parallel_CUDA、Parallel_FUSEDの各モードで速度と誤差を確認します。その後、自社タスクに近い小規模データで、長い系列ほど有利になるかを検証します。

本格導入を考えるのは、同条件のTransformerやMamba2に対して、明確なコスト削減、レイテンシ改善、メモリ削減、または長文保持性能の改善が確認できた後です。研究段階の技術なので、最初から本番の中核に置くより、探索的プロジェクトや社内PoCから始めるのが妥当です。

導入を急がなくてよいケース

既存LLMの品質やコストに大きな不満がない場合、ParaRNNへの移行を急ぐ必要はありません。特に、短文処理、FAQ応答、社内文書検索、定型文生成が中心なら、アーキテクチャ変更よりも、データ整備、評価指標、プロンプト設計、権限管理のほうが成果につながりやすいです。

よくある質問

Apple ParaRNNとは何ですか?

Apple ParaRNNは、非線形RNNを系列方向に並列学習するための研究フレームワークです。従来のRNNは時間ステップを順番に計算する必要があり、大規模学習では不利でした。ParaRNNは、系列全体の隠れ状態を方程式系としてまとめ、Newton反復と並列リダクションで解くことで、学習時のボトルネックを緩和します。現時点では製品機能ではなく、論文とオープンソース実装として公開されています。

ParaRNNはTransformerを置き換えますか?

すぐに置き換えるとは考えにくいです。Transformerはモデル、ツール、推論サーバー、評価、運用ノウハウのエコシステムが非常に成熟しています。ParaRNNは、長文推論や省メモリ性、非線形RNNの大規模学習という観点で有望な研究ですが、実務で主流になるには、再現実験、事前学習済みモデル、推論基盤、開発者向けツールの充実が必要です。

Mamba2とParaRNNの違いは何ですか?

Mamba2は状態空間モデルに基づき、効率的な長系列処理を目指すアーキテクチャです。線形性や構造化された計算を活かして高速化します。ParaRNNは、非線形RNNをNewton法で線形化しながら並列に解くことで、非線形再帰の表現力と学習効率の両立を狙います。どちらもTransformerの長文処理コストに対する代替候補ですが、設計思想と実装上の課題は異なります。

665倍高速化はどの処理が速くなったという意味ですか?

Appleが示す最大665倍高速化は、ナイーブな逐次RNNセル適用と、ParaRNNによる並列適用の比較として説明されています。LLMの事前学習全体が常に665倍速くなるという意味ではありません。実際の学習全体では、データ読み込み、分散通信、最適化、損失計算、GPU利用率など多くの要素が影響します。数字は大きな進歩を示す一方で、条件付きで読む必要があります。

ParaRNNはApple SiliconやiPhoneで使えますか?

現時点の公開情報だけでは、iPhoneやApple Silicon向けの製品機能として使えるとは言えません。GitHubのREADMEでは、加速モードにCUDA対応環境が必要とされています。Appleの研究であることと、すぐにAppleデバイス上の実装として提供されることは別です。将来的にオンデバイスAIの設計に影響する可能性はありますが、現段階では研究コードとして見るのが適切です。

企業が今すぐ検証する価値はありますか?

長文処理、ストリーミング推論、省メモリ推論、新しいLLMアーキテクチャの研究に課題を持つ企業なら、PoCとして検証する価値があります。一方、一般的な社内AI導入や文書検索が目的なら、まずは既存LLM、RAG、評価基盤、データ管理を整えるほうが効果的です。ParaRNNは、研究開発チームが中長期の選択肢として追うべき技術です。

まとめ:ParaRNNはRNN復権の可能性を示すが、実用化はこれから

Apple ParaRNNの重要性は、RNNの推論効率という強みを保ちながら、長年の弱点だった学習時の逐次ボトルネックに正面から取り組んだ点にあります。最大665倍高速化、7Bパラメータ規模のRNN学習、TransformerやMamba2に近い性能という結果は、LLMアーキテクチャの選択肢を広げるものです。

ただし、現時点では研究段階です。CUDA前提の実装、カスタムカーネル、数値誤差、セル設計の制約、再現性評価など、実務導入前に確認すべき点は多くあります。記事タイトルの問いに答えるなら、ParaRNNがすごいのは「RNNの表現力と推論効率を残したまま、大規模学習の壁を崩しにいったこと」です。

今後注目すべきなのは、第三者による再現実験、事前学習済みモデルの公開、Mamba系モデルや長文Transformerとの同条件比較、Apple SiliconやオンデバイスAIへの展開可能性です。Transformer一強に見えたLLM設計は、効率性をめぐって再び多様化しつつあります。ParaRNNは、その流れを象徴する研究の1つと言えるでしょう。

参考ソース

- Apple Machine Learning Research:ParaRNN: Large-Scale Nonlinear RNNs, Trainable in Parallel

- Apple Machine Learning Research:ParaRNN論文紹介ページ

- OpenReview:ParaRNN: Unlocking Parallel Training of Nonlinear RNNs for Large Language Models

- arXiv:ParaRNN: Unlocking Parallel Training of Nonlinear RNNs for Large Language Models

- GitHub:apple/ml-pararnn

- arXiv:Attention Is All You Need

- arXiv:Transformers are SSMs: Generalized Models and Efficient Algorithms Through Structured State Space Duality

- GitHub:state-spaces/mamba

コメント