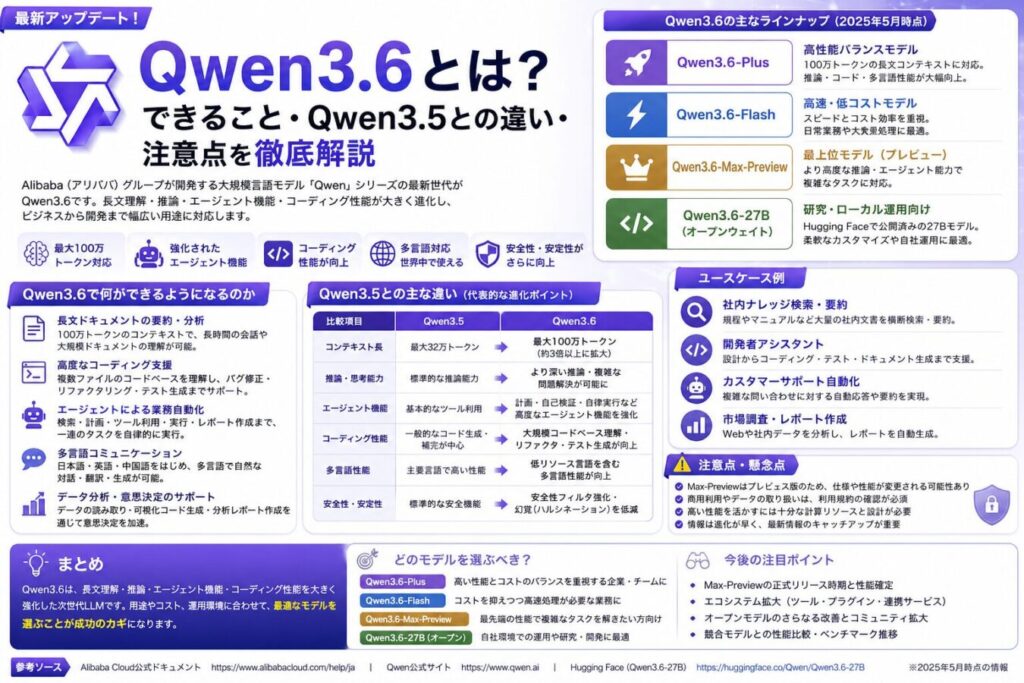

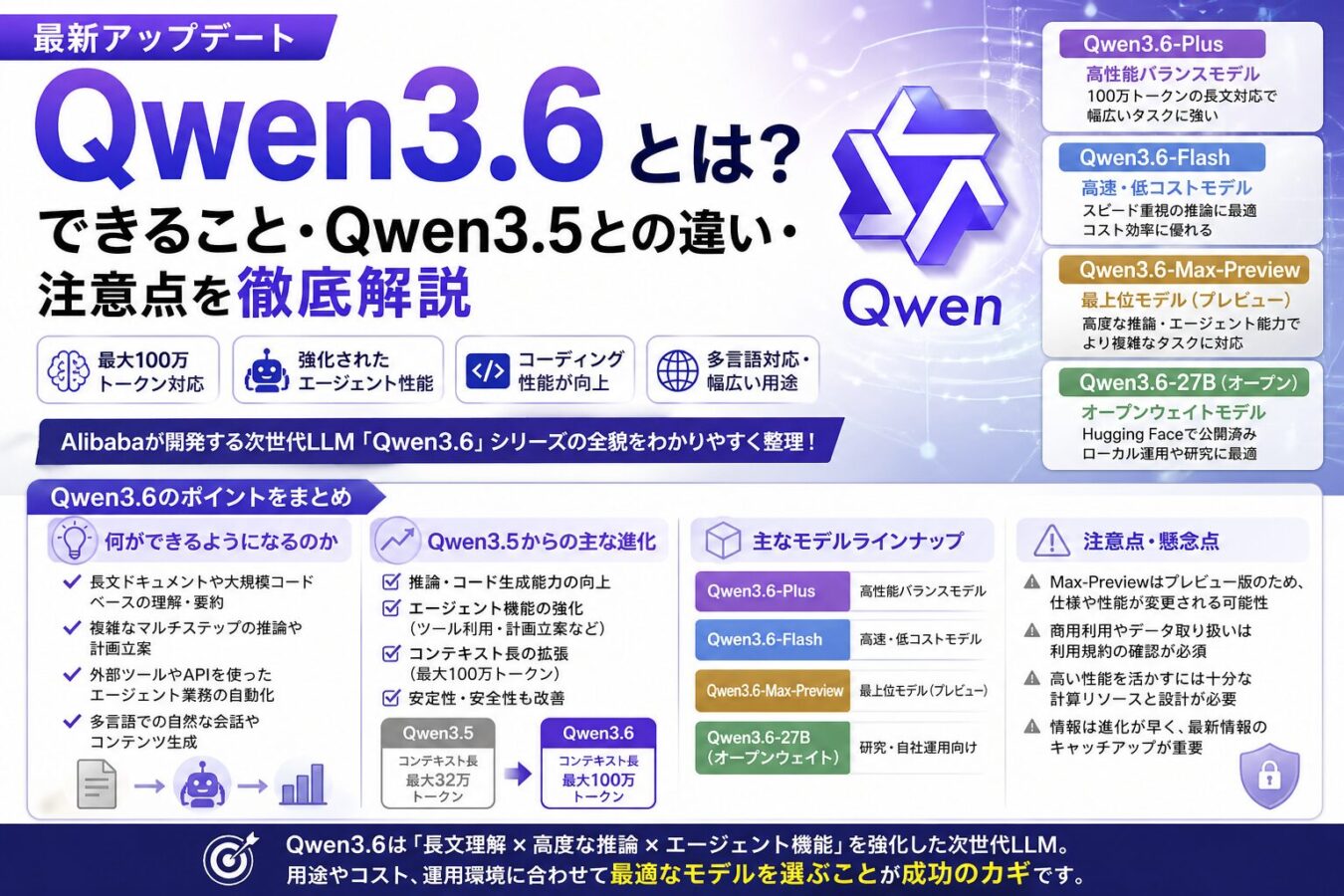

Qwen3.6は、Alibaba GroupのQwenチームが展開する大規模言語モデルシリーズの新世代です。単一のモデル名ではなく、クラウドAPIで使うPlus・Flash・Max Previewと、Hugging Faceなどで公開されるオープンウェイトモデルを含むラインナップとして理解すると整理しやすくなります。本記事では、2026年4月28日時点で確認できる公式情報をもとに、Qwen3.6で何ができるのか、Qwen3.5と何が違うのか、実務で導入する前に何を確認すべきかを解説します。

要点をひと目で確認!

導入:Qwen3.6は「長文理解・エージェント・コーディング」を重視した新世代モデル

Qwen3.6のポイントは、単に「賢くなったAI」と表現するよりも、長い文脈を扱う業務、外部ツールを使うエージェント、コードベースを理解して作業する開発支援に軸足を置いたモデル群として見ることです。Alibaba CloudのModel Studioでは、qwen3.6-plus、qwen3.6-flash、qwen3.6-max-previewが案内されており、用途に応じた使い分けが前提になっています。

結論から言えば、Qwen3.6は「大量の社内文書をまとめたい」「大規模なコードベースをAIに読ませたい」「ツール連携を伴う業務自動化を試したい」ユーザーにとって有力な選択肢です。一方で、すべての用途でQwen3.5や他社モデルを置き換えるものではありません。プレビュー版の仕様変更、データ取り扱い、API提供地域、長文利用時のコストは慎重に確認する必要があります。

何が発表されたのか:Qwen3.6の主なモデルラインナップ

Qwen3.6は、クラウドAPI向けモデルとオープンウェイトモデルに分けて考えると理解しやすくなります。公式GitHubでは、Qwen3.6はQwen3.5の基盤的な進歩を踏まえつつ、安定性、実用性、開発者にとっての使いやすいコーディング体験を重視したリリースと説明されています。Qwen3.6の公式リポジトリはQwenLM/Qwen3.6で確認できます。

Alibaba Cloud Model Studioの説明では、qwen3.6-plusはチャットボット、コンテンツ生成、要約、文書処理に推奨されるバランス型モデルです。1M、つまり100万トークンのコンテキストウィンドウと組み込みツールを備え、性能とコストのバランスを取りやすい位置づけです。qwen3.6-flashは同じく100万トークン文脈をサポートしつつ、コストを抑えたい用途に向けたモデルとして案内されています。

一方、qwen3.6-max-previewは、より強い推論能力が必要な場合に選ぶ上位モデルです。ただし、名前にPreviewとある通り、安定版ではなく、Model Studioの表でも組み込みツールやバッチ呼び出しなど一部機能はPlusやFlashと異なります。実務導入では、性能だけでなく「プレビュー版を本番に近い業務で使ってよいか」を別途判断する必要があります。

オープンウェイト側では、Qwen3.6-27BとQwen3.6-35B-A3Bが公開されています。Hugging Faceのモデルカードでは、27Bは27BパラメータのDenseモデル、35B-A3Bは総パラメータ35B・有効パラメータ3BのMoEモデルとして説明されています。どちらもApache 2.0ライセンスで公開されており、自社環境での検証や研究開発に使いやすい点が特徴です。

背景:なぜQwen3.6が注目されているのか

生成AIの競争軸は、単純なチャット性能から、長文処理、マルチモーダル入力、外部ツール利用、コーディング支援、業務エージェントへ移りつつあります。Qwen3.6は、この流れの中で「実際の業務に近い作業をどれだけ安定して進められるか」を強く意識したモデル群です。

Qwen3の時点でも、思考モードと非思考モードを統合し、複雑な推論では深く考え、通常の応答では素早く返す設計が注目されました。Qwen3の技術的な位置づけはQwen3 Technical Reportでも説明されています。Qwen3.6では、この方向性をさらに実務寄りに進め、コーディング、エージェント、長い文脈の維持に重点を置いています。

また、Qwen3.6が注目される理由は、クラウドAPIとオープンウェイトの両方を持つ点にもあります。ClaudeやGeminiのような高性能な閉鎖型APIは使いやすい一方、モデルの中身や運用環境を細かく制御することは難しくなります。Qwen3.6は、APIで素早く試し、必要に応じてオープンウェイト版で自社運用や研究に進むという選択肢を提供しています。

Qwen3.6で何ができるようになるのか

Qwen3.6で大きく変わるのは、これまで不可能だったことが突然すべて可能になるというより、長文・複雑作業・開発支援の精度と安定性を高めやすくなる点です。特にPlusとFlashは100万トークン文脈に対応しているため、長いマニュアル、規程、議事録、顧客対応履歴、複数ファイルの仕様書などをまとめて扱う用途に向いています。

たとえば社内ナレッジ検索では、従来は文書を細かく分割し、検索で拾った断片をLLMに渡すRAG構成が一般的でした。Qwen3.6の長文文脈を使えば、より広い範囲の文書を一度に読ませ、規程同士の矛盾、過去の変更履歴、例外条件をまとめて比較しやすくなります。ただし、すべての文書を丸ごと入れればよいわけではなく、入力コストと回答品質の検証は必要です。

コーディング支援では、大規模なリポジトリの構造理解、関連ファイルをまたいだ修正、テストコード生成、フロントエンドの挙動確認などが主な用途になります。Qwen3.6-27BとQwen3.6-35B-A3Bのモデルカードでは、エージェント型コーディングやリポジトリレベルの推論が強化された点が強調されています。Qwen CodeやQwen-Agentと組み合わせることで、単なるコード補完ではなく、調査、修正案、実行、再確認まで含む作業フローを組みやすくなります。

もう一つの重要な進歩は、思考文脈の扱いです。Qwen3.6のオープンウェイトモデルでは、直近の回答だけでなく、過去メッセージに含まれる推論の流れを保持して活用する「preserve_thinking」の考え方が紹介されています。長い開発セッションや複数段階の調査では、同じ前提を何度も説明し直す負担を減らせる可能性があります。

Qwen3.5との違い:単純な「上位互換」ではなく実務寄りの進化

Qwen3.6を理解するうえで注意したいのは、Qwen3.5もすでに高機能なモデル群であることです。Alibaba CloudのModel Studioでは、Qwen3.5-PlusやQwen3.5-Flashも100万トークン文脈に対応していました。そのため、Qwen3.6の差分は「文脈長が伸びたから新しい」という単純な話ではありません。

| 比較項目 | Qwen3.5 | Qwen3.6 |

|---|---|---|

| 主な方向性 | ネイティブなマルチモーダルエージェントを重視 | 安定性、実用性、コーディング、エージェント作業をさらに重視 |

| コンテキスト長 | Plus/Flashで100万トークン対応 | Plus/Flashで100万トークン対応。オープンモデルはネイティブ262K、拡張で約1M対応の説明あり |

| コーディング | コード生成や補助に対応 | リポジトリ単位の理解、エージェント型コーディング、フロントエンド作業をより重視 |

| オープンウェイト | 複数サイズのモデルを公開 | 27B Dense、35B-A3B MoEなどをApache 2.0で公開 |

| 導入判断 | 既存の安定運用がある場合は継続候補 | 新規検証や開発支援、エージェント用途で優先候補 |

したがって、すでにQwen3.5で十分な精度が出ている業務であれば、急いでQwen3.6へ移行する必要はありません。むしろ、長い会話で前提が崩れやすい、コード修正の一貫性に不満がある、ツール呼び出しを伴う業務自動化を進めたい、といった課題がある場合にQwen3.6を検証する価値が高くなります。

既存競合との比較

Qwen3.6の比較対象は、用途によって変わります。クラウドAPIとして見るならClaudeやGemini、コスト効率とオープンモデルとして見るならDeepSeek V4や従来のQwen3.5、ローカル運用として見るならLlama系やGemma系も候補になります。ここでは、実務で選定しやすいよう、性能、価格、用途、導入しやすさ、制限の観点で整理します。

| モデル・サービス | 主な強み | 価格・コスト感 | 導入しやすさ | 向いているケース | 注意点 |

|---|---|---|---|---|---|

| Qwen3.6 Plus/Flash | 100万トークン文脈、関数呼び出し、構造化出力、組み込みツール | Flashはコスト抑制、Plusは性能とコストのバランス重視 | Alibaba Cloud Model Studio経由でAPI利用 | 長文文書処理、社内ナレッジ、開発支援、業務エージェント | 提供地域、利用規約、データ保管場所の確認が必要 |

| Qwen3.6 Max Preview | より強い推論能力を狙う上位モデル | Plus/Flashより高コストになりやすい | APIで試しやすいがPreview扱い | 複雑な推論、設計レビュー、難度の高い分析 | プレビュー版のため仕様や性能が変わる可能性がある |

| Qwen3.6 27B/35B-A3B | Apache 2.0のオープンウェイト、自社運用や研究に使いやすい | API料金ではなくGPU・運用コストが中心 | Hugging Face、vLLM、SGLangなどで展開可能 | 自社環境運用、ファインチューニング、研究開発、データを外部に出しにくい用途 | 十分なGPUメモリ、推論基盤、監視体制が必要 |

| DeepSeek V4 | 1M文脈、Pro/Flash構成、コスト効率、オープンウェイト | 公式APIではFlashが低価格、Proは期間限定割引が案内されている | OpenAI互換・Anthropic互換APIに対応 | コスト重視の大量処理、エージェント型コーディング、長文処理 | 新モデルのため、安定性や運用実績は自社検証が必要 |

| Claude Opus/Sonnet系 | エージェント、長文、コーディング、企業利用の成熟度 | Anthropic公式ではSonnet 4.6が入力3ドル/出力15ドル、Opus 4.7が入力5ドル/出力25ドルの水準 | Claude API、Bedrock、Vertex AI、Microsoft Foundryなど選択肢が多い | 企業向けワークフロー、長文推論、品質重視の開発支援 | 閉鎖型APIのためモデル自体の自社運用はできない |

| Gemini 3.1 Pro Preview | マルチモーダル、Google連携、エージェント・vibe coding用途 | Google公式では標準APIで200K以下の入力2ドル、出力12ドルから | Google AI StudioやGemini APIで試しやすい | 画像・動画・検索連携を含む開発、Google Cloudとの統合 | Previewモデルは仕様変更やレート制限に注意 |

価格だけを見ると、DeepSeek V4 Flashのような低価格モデルは魅力的です。DeepSeekの公式ドキュメントでは、V4 FlashとV4 Proが1M文脈に対応し、ツール呼び出しやJSON出力にも対応すると説明されています。ただし、価格が低いモデルが常に最適とは限りません。回答品質、長い会話での一貫性、ツール呼び出しの安定性、サポート体制まで含めて比較する必要があります。

Claudeは閉鎖型APIですが、企業導入やエージェント型作業の実績、周辺ツールの成熟度で強みがあります。Anthropicのモデル概要では、現行Claudeモデルがテキスト・画像入力、テキスト出力、多言語、visionに対応すると説明されています。長文・高品質・運用安定性を重視する組織では、Qwen3.6とClaudeを同じ業務データで比較するのが現実的です。

GeminiはマルチモーダルとGoogleエコシステムとの接続性が強みです。GoogleのGemini APIのモデル一覧では、Gemini 3.1 Pro PreviewやGemini 2.5 Pro/Flashなどが用途別に案内されています。画像、動画、音声、検索、Google Cloudとの統合が重要な場合は、Qwen3.6単独ではなくGeminiも候補に入れるべきです。

懸念点・注意点:長文と高性能にはコストと運用負荷が伴う

Qwen3.6の最大の魅力の一つは長文対応ですが、長文対応はそのまま低コストを意味しません。100万トークンの入力を頻繁に使えば、API料金、待ち時間、キャッシュ設計、ログ管理の負担は増えます。業務では、すべてを投入するより、検索、要約、メタデータ付与、段階的な読み込みを組み合わせたほうが安定するケースもあります。

Max Previewの扱いにも注意が必要です。Previewモデルは、性能が高い一方で、正式版に向けて仕様、価格、機能、レート制限が変わる可能性があります。社内の基幹業務や顧客向けサービスに組み込む場合は、代替モデルへの切り替え手順を用意し、特定モデルに依存しすぎない設計が望ましいです。

オープンウェイトモデルは自由度が高い反面、運用難易度が上がります。Qwen3.6-35B-A3Bのモデルカードでは、vLLMやSGLangでの提供例が示されていますが、実際にはGPUメモリ、量子化、コンテキスト長、同時実行数、監視、ログ、セキュリティパッチまで考慮する必要があります。APIモデルより安く見えても、運用人員とインフラ費用を含めると逆転する場合があります。

データ取り扱いも重要です。社内文書、顧客情報、ソースコードを外部APIに送る場合、データ保管場所、学習利用の有無、ログ保持期間、契約条件を確認しなければなりません。Alibaba Cloud、Anthropic、Google、DeepSeekのいずれを使う場合でも、モデル性能だけでなく、法務・セキュリティ・コンプライアンスの確認を導入プロセスに含めるべきです。

導入メリットを得やすい人・組織

Qwen3.6が向いている人・組織

Qwen3.6が特に向いているのは、長い文脈を前提にした業務を抱える組織です。たとえば、数百ページの規程やマニュアルを横断して確認する管理部門、顧客対応履歴と製品仕様を照合するサポート部門、大量の議事録や調査資料から論点を抽出する企画部門では、100万トークン文脈を持つPlus/Flashを試す価値があります。

開発チームにも適しています。複数ファイルにまたがる不具合調査、既存コードの設計意図の把握、テストケース生成、リファクタリング案の作成など、単発のコード補完ではなく「プロジェクト全体を読んで判断する」作業では、Qwen3.6-27Bや35B-A3B、Qwen Codeとの組み合わせが候補になります。

また、外部APIにデータを出しにくい組織では、オープンウェイト版を自社環境で検証できる点が魅力です。もちろん、ローカル運用には十分な計算資源とMLOps体制が必要ですが、セキュリティ要件が高い研究開発、金融、製造、公共系の検証では選択肢が広がります。

現時点では向いていない人・組織

一方、短い文章の要約や簡単なチャット応答が中心であれば、Qwen3.6を急いで導入する必要はありません。Qwen3.5、既存のClaudeやGemini、あるいはより軽量なモデルで十分なケースがあります。特に、入力が短く、ツール連携も不要で、品質要求が高くない業務では、長文対応モデルの強みを活かしにくくなります。

AI導入の目的が曖昧な組織にも向きません。Qwen3.6は多機能ですが、「何を自動化するのか」「失敗時に誰が確認するのか」「どの精度なら業務に使えるのか」が決まっていない状態で導入すると、PoCだけで終わりやすくなります。まずは業務課題、評価データ、成功基準を定義することが先です。

また、社内にAPI管理、アクセス制御、ログ監査、プロンプト管理の体制がない場合も慎重に進めるべきです。高性能なモデルほど、誤った回答がもっともらしく見えたり、大量のデータを扱うことで情報漏えいリスクが増えたりします。導入判断は、モデルの性能だけでなく、運用体制とセットで行う必要があります。

実務導入を判断する際のポイント

まず確認したい前提条件

Qwen3.6を検討する前に、まず「長文文脈やエージェント機能が本当に必要か」を確認します。社内FAQのように短い質問と短い回答で済む業務であれば、100万トークン文脈は過剰です。逆に、複数資料の整合性確認、長い契約書の比較、巨大なコードベースの理解など、文脈の広さが成果に直結する業務なら検討価値があります。

導入判断で見るべきポイント

第一に見るべきは精度です。一般的なベンチマークのスコアではなく、自社の文書、コード、問い合わせデータで評価する必要があります。特に長文では、冒頭の前提を後半で忘れないか、複数の例外条件を混同しないか、出典に基づいて答えられるかを確認します。

第二に再現性です。同じ入力に対して回答の品質が大きく揺れると、業務フローに組み込みにくくなります。温度設定、思考モード、システムプロンプト、RAG構成、キャッシュの有無を固定し、どの条件で安定するかを見ます。Qwen3.6では思考モードや履歴の扱いが重要になるため、検証ログを残して比較することが大切です。

第三にコストです。1回あたりのトークン単価だけでなく、長文入力の頻度、出力の長さ、失敗時の再実行、キャッシュ利用、ピーク時の同時実行数を含めて試算します。Flashで十分な業務とPlusやMax Previewが必要な業務を分けるだけでも、月額コストは大きく変わります。

第四に既存システムとの接続性です。Qwen3.6は関数呼び出しや構造化出力に対応しますが、既存のSaaS、データベース、チケット管理、CI/CD、権限管理と安全に接続できなければ実務では使いにくくなります。人間の承認を挟むポイント、失敗時のロールバック、ログ監査も設計に含めるべきです。

第五にベンダーロックインです。Qwen3.6のAPIモデルを使う場合でも、OpenAI互換のインターフェースや抽象化レイヤーを使っておくと、Claude、Gemini、DeepSeek、ローカルQwenへ切り替えやすくなります。プレビュー版を使う場合は、代替モデルで最低限の業務を継続できる設計が特に重要です。

試験導入から本格導入までの見方

試験導入では、まず1つの業務に絞るのが現実的です。たとえば「月次レポート作成の下書き」「大規模コードベースの不具合調査補助」「社内規程の差分確認」のように、入力、出力、評価基準を明確にできる業務を選びます。人間がレビューできる範囲で始め、回答の誤り、見落とし、コスト、処理時間を記録します。

本格導入に進むかどうかは、単に便利だったかではなく、作業時間の削減、レビュー負担の変化、誤回答率、再実行率、利用者満足度、セキュリティ事故のリスクで判断します。特にエージェント機能を使う場合、AIが外部ツールを実行する前に人間の承認を挟む設計から始めるのが安全です。

導入を急がなくてよいケース

短文生成、単純な翻訳、定型メール作成など、すでに既存モデルで十分な品質とコストを実現できている業務では、Qwen3.6への移行を急ぐ必要はありません。また、セキュリティ審査や法務確認が追いついていない組織では、まず利用ルールとデータ分類を整えるべきです。新モデルの導入は、話題性ではなく業務上のボトルネックから逆算して判断するのが安全です。

よくある質問

Qwen3.6は無料で使えますか?

Qwen3.6のクラウドAPIはAlibaba Cloud Model Studio経由で提供されるため、無料枠や料金体系は利用地域、プラン、時期によって変わります。一方、Qwen3.6-27BやQwen3.6-35B-A3BのようなオープンウェイトモデルはHugging Faceで公開されていますが、自分で動かす場合はGPU、ストレージ、推論サーバー、運用人員のコストが発生します。無料かどうかではなく、API料金と自社運用コストを比較して判断する必要があります。

Qwen3.6とQwen3.5はどちらを使うべきですか?

既存業務でQwen3.5が安定しており、短い入力や一般的なチャットが中心なら、すぐに移行する必要はありません。Qwen3.6を優先したいのは、大規模コードベース、長文資料、複数段階のエージェント作業で品質や一貫性に課題がある場合です。まず同じ業務データでQwen3.5とQwen3.6を比較し、精度、処理時間、コスト、失敗時のリカバリーを見て判断するのが現実的です。

Qwen3.6-Plus、Flash、Max Previewの違いは何ですか?

Plusは性能とコストのバランスを重視した汎用モデル、Flashはより高速・低コストに寄せたモデル、Max Previewは高い推論能力を狙う上位モデルと考えると分かりやすいです。PlusとFlashは100万トークン文脈や組み込みツールに対応しますが、Max Previewは256K文脈で、Preview扱いのため仕様変更リスクがあります。業務では、まずPlusで品質を確認し、量が多い処理をFlashへ寄せる進め方が無難です。

Qwen3.6は日本語でも使えますか?

Qwenシリーズは多言語対応を重視しており、日本語の文章生成、要約、翻訳、コードコメントの理解などにも利用できます。ただし、日本語業務での実用性は、公開ベンチマークだけでは判断できません。社内特有の用語、敬語、法務文書、医療・金融などの専門表現では誤りが出る可能性があります。日本語で使う場合も、自社データを使った評価セットを作り、誤訳やニュアンスの抜けを確認してください。

Qwen3.6はローカルPCで動かせますか?

小さな量子化版であれば個人環境で試せる可能性はありますが、Qwen3.6-27Bや35B-A3Bを長い文脈で本格運用するには、十分なGPUメモリと推論基盤が必要です。Hugging FaceのモデルカードではvLLMやSGLangなどの利用例が示されていますが、実運用では同時接続数、応答速度、メモリ不足、ログ管理も問題になります。検証は短い文脈から始め、必要に応じてクラウドGPUやAPI利用も比較しましょう。

Qwen3.6はClaudeやGeminiより優れていますか?

一概には言えません。Qwen3.6は長文、オープンウェイト、自社運用、コーディング支援の柔軟性で魅力があります。一方、Claudeは企業向けの運用実績やエージェント作業、GeminiはマルチモーダルとGoogle連携に強みがあります。重要なのは、一般的なランキングではなく、自社の入力データ、セキュリティ要件、コスト上限、既存システムとの接続性で比較することです。

まとめ:Qwen3.6は「用途別に選ぶ」ことが成功の鍵

Qwen3.6は、Qwen3.5の延長線上にある単なる小幅アップデートではなく、長文理解、エージェント、コーディング、オープンウェイト運用をより実務寄りに進めたモデル群です。PlusとFlashは100万トークン文脈を活かした文書処理や業務自動化に向き、Max Previewは高難度推論の検証候補になります。27Bや35B-A3Bは、自社環境での運用や研究開発を重視するチームにとって重要な選択肢です。

ただし、導入判断では「最新だから使う」のではなく、どの業務でどの課題を解決するのかを明確にする必要があります。長文を扱うならコストと精度、エージェントを使うならツール実行の安全性、オープンウェイトを使うならGPUと運用体制がボトルネックになります。Qwen3.6は有力な候補ですが、Claude、Gemini、DeepSeek、Qwen3.5と同じ業務データで比較し、自社に合うモデルを選ぶことが最も重要です。

参考ソース

- Alibaba Cloud Model Studio:Text generation models

- QwenLM/Qwen3.6 GitHub Repository

- Hugging Face:Qwen3.6-27B

- Hugging Face:Qwen3.6-35B-A3B

- Qwen3 Technical Report

- DeepSeek V4 Preview Release

- DeepSeek API Models & Pricing

- Anthropic Claude Models Overview

- Anthropic Claude API Pricing

- Google Gemini API Models

- Google Gemini API Pricing

コメント