本記事では、生成AIを使う前に知っておきたい注意点を初心者向けに整理します。結論から言うと、生成AIは便利でも、誤情報、著作権や利用条件、個人情報、業務利用ルールの4点を確認しないまま使うとトラブルになりやすいです。特に重要なのは、「もっともらしい出力でも正しいとは限らない」「出力は何でも自由に使えるとは限らない」「入力した情報の扱いを意識する」「公開前は人が確認する」という基本です。

生成AIは、文章作成、要約、翻訳、画像生成、情報整理などに広く使われています。しかし、便利さが目立つ一方で、使い方を誤ると問題が起きやすいです。Google CloudのResponsible AIでは、生成AIには factuality や hallucinations の課題があると説明されています。AnthropicのReduce hallucinationsでも、モデルが事実と異なる内容を返す可能性を前提にした運用が案内されています。つまり、生成AIは「そのまま信用する道具」ではなく、「人が確認しながら活用する道具」と考える方が安全です。

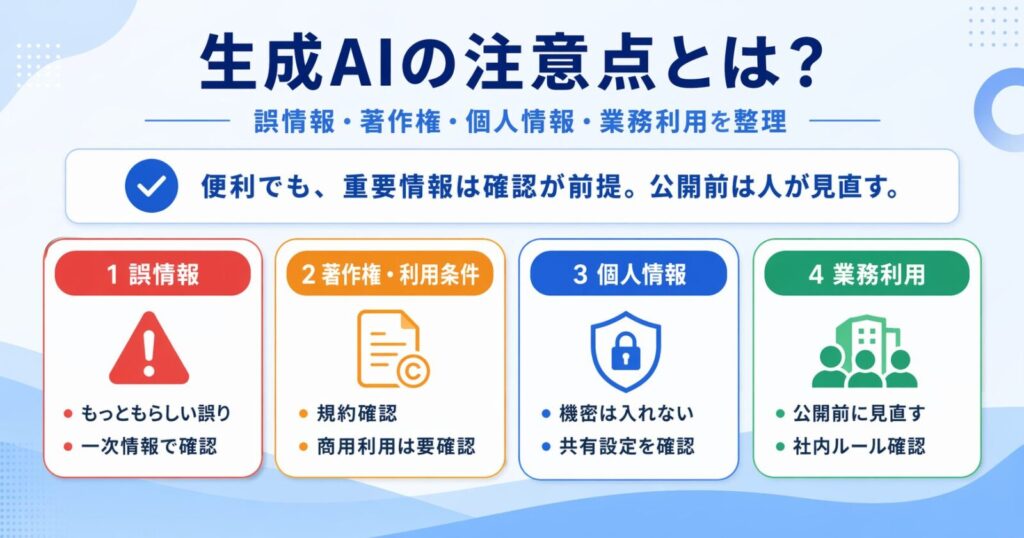

要点をひと目で把握!

生成AIで特に注意したい4つのポイント

初心者が最初に押さえたい注意点は、次の4つです。

- 誤情報が混ざる可能性がある

- 著作権や利用条件を確認せず使うと危ない

- 個人情報や機密情報の入力に注意が必要

- 業務利用では人の確認とルール整備が必要

この4つは別々の問題に見えますが、実際にはつながっています。たとえば、誤った内容をそのまま公開すれば信用を失いますし、規約確認なしに商用利用すれば後で困る可能性があります。個人情報を安易に入力すれば、社内ルールやプライバシー面の問題にもつながります。

誤情報のリスク

生成AIでもっとも基本的な注意点は、もっともらしい誤りを返すことがある点です。Google CloudのResponsible AIでは、モデルは factually incorrect, irrelevant, inappropriate, or nonsensical な出力をすることがあると説明されています。つまり、自然な文章で答えていても、内容まで正しいとは限りません。

特に誤りやすい場面

誤りが問題になりやすいのは、最新ニュース、法律、医療、金融、数値、仕様の細かい違いなどです。こうした分野では、少しのズレでも大きな誤解につながります。生成AIで下調べや整理をするのは便利ですが、最終的な確認は元ソースを見る方が安全です。

どう対策するか

対策として重要なのは、一次情報に当たることです。企業発表なら公式ブログ、製品仕様なら公式ドキュメント、制度なら公的機関の案内ページを見る習慣をつけると、誤情報リスクを減らしやすくなります。生成AIには「整理役」を任せて、「正誤判定」は人が行う方が現実的です。

著作権と利用条件の注意点

生成AIを使うとき、著作権はかなり誤解されやすい論点です。よくある誤解は、「AIが作ったものだから自由に使える」「出力はすべて自分のものだから何に使っても大丈夫」という考え方です。実際には、使うサービスの利用規約、商用利用条件、生成時に参照した素材の扱い、公開のしかたなどを確認する必要があります。

出力は何でも自由とは限らない

たとえばOpenAIのTerms of Useでは、ユーザーは入力の権利を保持し、出力についても法令が許す範囲で権利を持つと説明されています。ただし、これは「どんな使い方でも問題ない」という意味ではありません。法律や第三者の権利、利用規約との関係は別に確認が必要です。

商用利用や公開前に確認したいこと

記事、広告、販売物、SNS投稿、資料配布など、外に出す用途では特に慎重に確認した方がよいです。使ったサービスの規約、ブランド表記、画像利用条件、他者の権利侵害がないかを見ておくと安全です。生成AIは便利ですが、確認作業まで省略できるわけではありません。

個人情報と機密情報の注意点

生成AIに入力した情報の扱いは、サービスや契約形態によって違います。だからこそ、個人情報や機密情報を安易に入力しないことが基本です。OpenAIのConsumer PrivacyやSecurity and Privacyでは、データコントロールや学習利用に関する設定が案内されていますが、それでも入力する内容に注意する必要はあります。

入れない方がよい情報

氏名、住所、電話番号、メールアドレス、顧客情報、未公開資料、社内機密、契約前の情報、個人を特定できる詳細なデータなどは、安易に入力しない方が安全です。特に業務で使う場合は、社内ルールや契約条件も確認した方がよいです。

設定確認も重要

学習への利用設定、履歴管理、共有範囲、ワークスペースの扱いなど、サービス側の設定も確認しておくと安心です。GoogleやOpenAIなど各社はプライバシーやデータコントロールの案内ページを用意しているので、実際に使う前に見ておく価値があります。

業務利用での注意点

個人利用では見逃せても、業務利用では問題になりやすい点があります。たとえば、生成AIが作った文章をそのまま顧客向けに送る、社内ルールを確認せず機密性の高い内容を入力する、出力根拠を確認せず報告書に入れる、といった使い方は危険です。

公開前は人が確認する

生成AIの出力は、下書きや補助として使う方が安全です。最終的に外へ出す文書、社内決裁に使う資料、契約や制度に関わる説明、対外発信は、人が見直す工程を外さない方がよいです。便利さより、確認工程の維持が重要です。

社内ルールと役割分担

業務利用では、「何を入力してよいか」「誰が確認するか」「どこまでAIに任せるか」を決めておくと事故を減らしやすいです。特に、顧客情報、法務、財務、広報、医療関連などは、AI利用ルールが曖昧なままだと危険です。

生成AIを安全に使うための基本

生成AIを安全に使うための基本は、難しくありません。最初は次の考え方で十分です。

- 重要な内容は一次情報で確認する

- 入力する情報は最小限にする

- 規約や利用条件を確認する

- 公開前は人が見直す

- まずは影響の小さい用途から試す

たとえば、メールのたたき台、記事見出し案、要約、比較観点の洗い出し、学習補助のような、確認しやすく影響が小さい用途から始めると、生成AIの良さを活かしつつリスクも抑えやすいです。

よくある質問

生成AIで一番注意すべきことは何ですか?

もっとも基本なのは、自然な文章でも正しいとは限らない点です。特に重要情報は元ソース確認が必要です。そのうえで、個人情報、著作権、業務利用ルールも確認する方が安全です。

生成AIの出力は自由に使えますか?

必ずしもそうではありません。サービスごとの規約、法令、商用利用条件、第三者の権利との関係を確認する必要があります。特に公開や販売を伴う利用では慎重な確認が必要です。

生成AIに個人情報を入れても大丈夫ですか?

安易には入れない方が安全です。サービスの設定や契約条件を確認しつつ、できるだけ個人情報や機密情報は避けるのが基本です。

生成AIを仕事で使うのは危険ですか?

危険というより、確認なしの利用が危ないです。ルールを整え、人が最終確認する前提で使えば、業務効率化に役立つ場面は多いです。

初心者はどう使い始めると安全ですか?

まずは要約、見出し案、文章の言い換え、学習補助など、影響の小さい用途から試すのがおすすめです。いきなり重要文書や対外発信に使うより、安全に感覚をつかみやすいです。

まとめ

生成AIの注意点とは、誤情報、著作権や利用条件、個人情報、業務利用ルールを確認せずに使うとトラブルになりやすいということです。便利だからこそ、「そのまま使う」のではなく、「確認しながら使う」ことが重要です。

生成AIは危険だから使わない、ではなく、注意点を理解して賢く使う方が現実的です。まずは一次情報確認と人の見直しを前提に、小さな用途から活用を広げていくと失敗しにくいです。

参考ソース

- NIST公式: Artificial Intelligence Risk Management Framework – Generative AI Profile

- Google Cloud公式: Responsible AI | Generative AI on Vertex AI

- Google Cloud公式: Safety (Responsible AI) | Gemini Enterprise Agent Platform

- OpenAI公式: ChatGPT Privacy Settings

- OpenAI公式: Security and privacy at OpenAI

- OpenAI公式: Terms of Use

- Anthropic公式: Reduce hallucinations

コメント