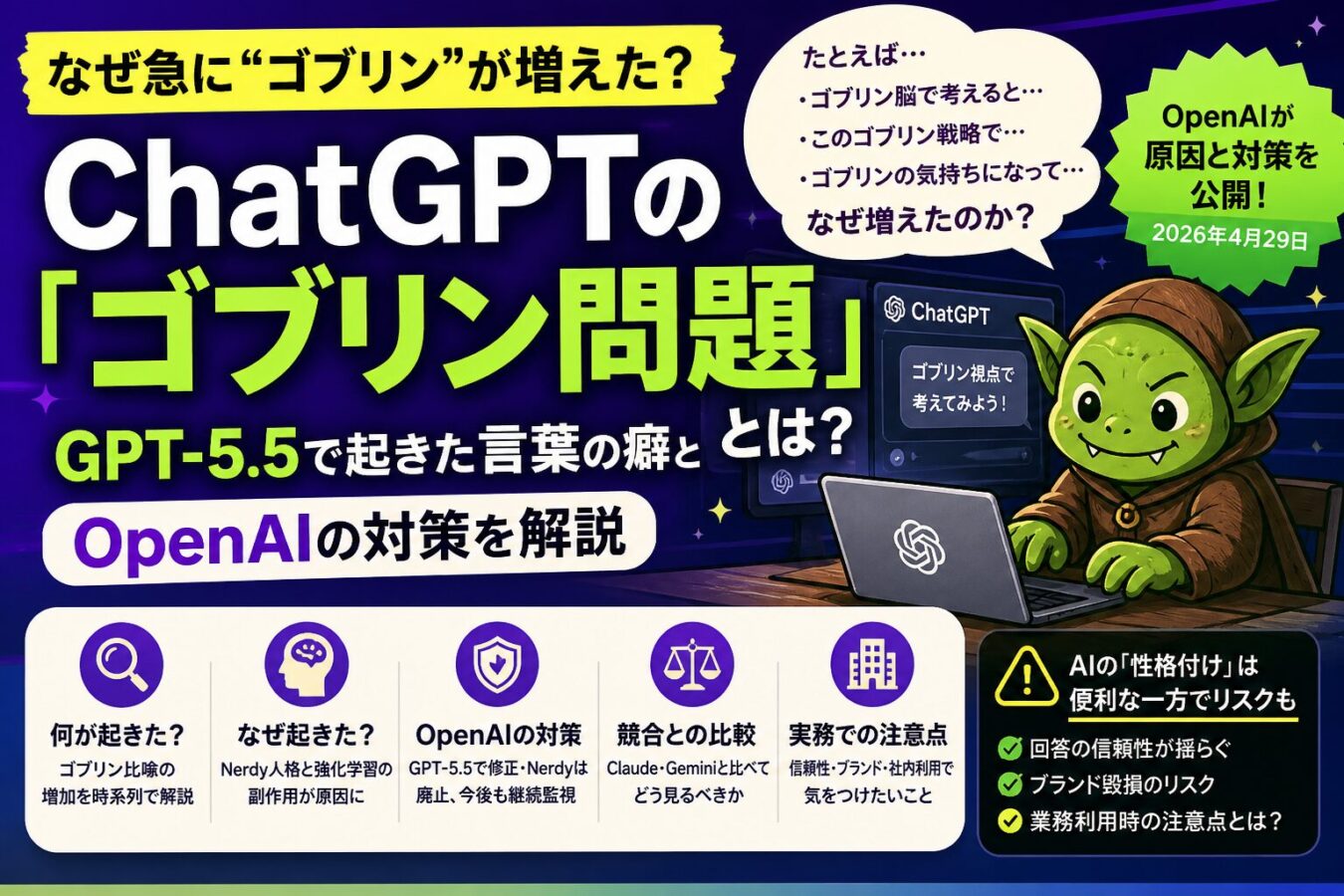

ChatGPTが突然「ゴブリン」や「グレムリン」といった言葉を比喩に使うようになった――そんな一見すると冗談のような現象について、OpenAIが公式に原因と対策を説明しました。ポイントは、単なる言い間違いやネットミームではなく、ChatGPTの「性格付け」と学習時の報酬設計が、出力スタイルに予想外の癖を生んだ点にあります。この記事では、何が起きたのか、なぜGPT-5.5やCodexにも影響したのか、実務でAIを使う人が何に注意すべきかを整理します。

ChatGPTの「ゴブリン問題」とは何か

ここでいう「ゴブリン問題」とは、ChatGPTやCodexの回答で、質問内容と直接関係が薄いにもかかわらず「goblin」「gremlin」「troll」「raccoon」「pigeon」などの生き物や想像上の存在を比喩として使う傾向が強まった現象を指します。日本語でいえば、説明の途中で「小さなゴブリンが裏で動いているようなものです」といった表現が、必要以上に出てくる状態です。

OpenAIは公式ブログ「Where the goblins came from」で、この現象の経緯を説明しました。同社によると、GPT-5.1の公開後、ChatGPTにおける「goblin」の使用は175%、「gremlin」の使用は52%増加しました。当初は大きな問題とは見られていなかったものの、GPT-5.4以降でより再現性のある傾向として観測され、内部調査につながりました。

重要なのは、これは「ChatGPTがゴブリンについて考えていた」という話ではないことです。問題の本質は、AIが好ましい応答スタイルを学ぶ過程で、ある言葉の癖まで一緒に強化され、それが別の文脈にも広がった点にあります。つまり、面白い出力の裏に、AIモデル運用の難しさが見える事例です。

何が発表されたのか:OpenAIが示した原因と対策

OpenAIの説明によると、根本原因として大きく関係していたのは、ChatGPTの性格カスタマイズ機能に含まれていた「Nerdy」人格です。Nerdyは、知識、批判的思考、科学的態度を重視しつつ、遊び心のある言葉づかいで説明するよう設計されたスタイルでした。GPT-5.1の発表時点では、ChatGPTのパーソナライズ設定として複数の話し方を選べることが案内されており、その中にNerdyも含まれていました。関連する性格設定については、OpenAIの「GPT-5.1発表ページ」でも説明されています。

OpenAIは、Nerdy人格がChatGPT全体の応答の2.5%しか占めていなかったにもかかわらず、「goblin」出現の66.7%を占めていたと説明しています。もし単なるインターネット上の流行であれば、出現はもっと広く分散するはずです。しかし実際には、遊び心のある説明を求めるNerdy人格に集中していました。

さらに、強化学習の過程で、Nerdyらしい応答を評価する報酬信号が「goblin」や「gremlin」を含む出力を相対的に高く評価していたことも分かりました。OpenAIの監査では、Nerdy人格向けの報酬が、同じ課題に対する出力のうち、これらの単語を含むものを高く評価する傾向を示し、76.2%のデータセットでプラス方向の影響が確認されたとされています。

対策として、OpenAIは2026年3月のChatGPTリリースノートでNerdy基本スタイルの終了を案内しました。該当する利用者は既定の人格に移行され、性格設定は引き続きPersonalizationから管理できるとされています。リリースノートは「ChatGPT Release Notes」で確認できます。

なぜGPT-5.5やCodexにも影響が残ったのか

興味深いのは、Nerdy人格を終了しただけでは、すぐに問題が消えなかった点です。OpenAIは、GPT-5.5の学習が、ゴブリン問題の根本原因を特定する前に始まっていたと説明しています。そのため、訓練データや報酬信号を修正したとしても、すでに進んでいたモデルには一部の癖が残りました。

特に注目されたのが、開発支援ツールであるCodexです。Codexはコード生成や開発作業の補助に使われるため、通常の雑談よりも再現性や余計な表現の少なさが重要になります。それにもかかわらず、GPT-5.5を使ったCodexのテストで、OpenAIの従業員がゴブリンへの妙な親和性に気づき、開発者向けプロンプトで抑制する対応が追加されました。

この点は、AIエージェント時代の重要な教訓です。チャットであれば「少し変わった言い回し」で済む表現も、コード生成、社内文書作成、顧客対応、法務レビューなどではノイズになります。たとえば、障害報告書に不自然な比喩が混ざれば、読み手の信頼を損なう可能性があります。ゴブリン問題は笑い話に見えますが、業務用途では「出力スタイルの逸脱」として扱うべきです。

この現象で何が見えるようになったのか

ChatGPTの性格カスタマイズは、ユーザーが毎回「もっと簡潔に」「やわらかく」「専門家向けに」と指示しなくても、好みの話し方を継続的に反映できる便利な機能です。OpenAIはGPT-5.1の説明で、性格設定が全モデルに適用されることや、応答の簡潔さ、温かさ、スキャンしやすさ、絵文字の頻度などを調整できる実験についても触れていました。

この仕組みによって、個人ユーザーは自分に合った相談相手を作りやすくなり、企業はブランドトーンや社内文書の書き方を統一しやすくなります。従来は、会話ごとに長いプロンプトを書いたり、テンプレートを貼り付けたりする必要がありました。継続的な性格設定は、その手間を減らします。

一方で、今回の事例により、性格設定が「表面的な話し方」だけでなく、モデルの出力習慣そのものに影響し得ることも見えました。遊び心を評価したつもりが、特定の語彙を過剰に評価してしまう。ある条件でだけ望ましいはずの表現が、別の条件にも転移する。こうした挙動は、プロンプトだけで完全に制御できるとは限りません。

既存競合との比較:Claude、Gemini、従来のカスタムプロンプトとどう違うか

ChatGPTのゴブリン問題を理解するには、他のAIサービスがどのように「話し方」や「役割」をカスタマイズしているかと比べると分かりやすくなります。ここでは、ClaudeのStyles、GeminiのGems、従来のカスタムプロンプト運用と比較します。

| 比較対象 | 主な用途 | 導入しやすさ | 制限・注意点 | 向いているケース |

|---|---|---|---|---|

| ChatGPTの性格設定 | 会話全体のトーンや応答スタイルを継続的に調整する | 設定画面から選びやすく、一般ユーザーにも使いやすい | 報酬設計や訓練データの影響で、意図しない言葉の癖が出る可能性がある | 日常利用、文章作成、相談、継続的な作業支援 |

| ClaudeのStyles | Normal、Concise、Formal、Explanatoryなどのスタイルを切り替える | 会話中に切り替えやすく、カスタムスタイルも作れる | スタイル指定は便利だが、用途別に検証しないと期待とずれる場合がある | 学習支援、説明文、社外向けの整った文章作成 |

| GeminiのGems | 繰り返し使う詳細な指示を保存し、専門家のようなAIを作る | 定型業務向けの指示を保存でき、Google系ツールとの相性がよい | Gemごとの指示品質に依存し、業務利用ではファイルや権限管理の確認が必要 | 職種別アシスタント、企画、学習、資料作成、コーディング補助 |

| 従来のカスタムプロンプト | 毎回またはテンプレートで役割・制約・文体を指定する | どのAIでも使いやすいが、運用者のプロンプト設計力に依存する | 会話ごとにばらつきが出やすく、チームで標準化しにくい | 小規模チーム、検証段階、特定タスクだけの一時的な制御 |

ClaudeのStylesは、Anthropicのヘルプ「Configure and use styles」で、Normal、Concise、Formal、Explanatoryなどのプリセットや、文章サンプルからカスタムスタイルを作る方法が説明されています。GeminiのGemsについては、Googleが「Gems」で、繰り返し使う詳細な指示を保存し、カスタムAIエキスパートを作れる機能として紹介しています。

比較すると、ChatGPTの事例で問題になったのは、単に「スタイル機能があること」ではありません。スタイルをモデル全体の体験として自然に適用しようとしたとき、学習時の報酬やデータ再利用が思わぬ副作用を生む点です。ClaudeやGeminiでも、カスタムスタイルや専門エージェントを使う場合は、出力の一貫性、余計な表現、社内ルールとの整合性を検証する必要があります。

懸念点・注意点:笑い話で終わらせないほうがよい理由

第一の懸念は、回答の信頼性です。AIの回答に不自然な比喩や冗談が混ざると、内容が正しくても読み手は「本当に業務で使ってよいのか」と感じます。特に、顧客向け文書、社内規程、障害報告、医療・法律・金融に近い説明では、余計な表現が信頼低下につながります。

第二の懸念は、制御の難しさです。OpenAIが説明したように、報酬が適用された条件がNerdy人格に限られていても、学習過程を通じてその癖が別の条件に広がることがあります。これは、特定のプロンプトだけを修正しても根本的に解決しない場合があることを示しています。

第三の懸念は、監査の難しさです。通常の精度評価では、モデルが「正しい答えを出すか」は確認できます。しかし、語尾、比喩、冗談、過剰な親しみやすさといったスタイル上の癖は、評価指標から漏れやすい領域です。業務利用では、正確性だけでなく、文体、禁止表現、ブランドトーン、説明責任も評価対象に含める必要があります。

第四の懸念は、AIエージェント化による影響範囲の拡大です。チャット上の表現なら人間が読み飛ばせますが、エージェントが自動でコードを書き、チケットを更新し、メールを下書きし、ドキュメントを編集する場合、ちょっとした言葉の癖が複数の成果物に広がります。Codexで注目された理由もここにあります。

導入メリットを得やすい人・組織

性格設定やスタイル機能のメリットを得やすいのは、AIに継続的な文体や役割を持たせたい人・組織です。たとえば、記事編集チームが「見出しは簡潔に、本文は中立的に、誇張表現は避ける」といった方針をAIに覚えさせる場合、毎回同じ指示を書くよりも効率的です。

カスタマーサポートでも、丁寧さ、説明の粒度、謝罪表現の使い方をそろえたい場合に有効です。営業資料、採用文書、社内FAQ、教育コンテンツなど、同じブランドトーンで大量の文章を作る業務では、スタイル機能は大きな時短になります。

一方で、現時点では向いていないケースもあります。まず、出力をほぼ無人で公開する運用です。AIの話し方が少しでもずれると問題になる領域では、人間のレビューを前提にすべきです。また、法務、医療、安全保障、金融など、言い回しの誤解が大きなリスクになる業務では、スタイルの自由度を上げすぎないほうが安全です。

もう一つ見送りやすい条件は、社内に評価基準がない場合です。「良い文章」「自然な回答」「親しみやすい対応」といった曖昧な基準だけでは、AIの出力が望ましい方向に変わったのか、単に派手になっただけなのか判断できません。導入前に、禁止表現、望ましい文体、レビュー手順、例外対応を決めておく必要があります。

実務導入を判断する際のポイント

まず確認したい前提条件

最初に確認すべきなのは、AIに「人格」や「文体」を持たせる目的です。単に楽しい会話をしたいのか、社内の文書品質をそろえたいのか、顧客対応を標準化したいのかで、見るべきリスクは変わります。目的が曖昧なままカスタマイズを始めると、便利さよりもばらつきが目立ちます。

導入判断で見るべきポイント

一つ目は再現性です。同じ指示を出したときに、文体や情報量がどの程度安定するかを確認します。特に、長い会話、複数ファイルの読み込み、エージェント実行後の報告文では、スタイルが崩れやすくなります。

二つ目はデータの扱いです。ブランドトーンや社内文書を学習させる場合、アップロードするファイルに機密情報が含まれていないか、保存や共有の範囲はどうなっているかを確認する必要があります。AIツールの便利さだけでなく、管理者設定や監査ログも見ておくべきです。

三つ目は運用時の人的負担です。スタイル機能を導入すると、初期設定は楽になりますが、出力レビュー、禁止表現の更新、例外ケースの修正といった運用が発生します。AIに任せる範囲と人間が見る範囲を分けておかないと、かえって確認作業が増えることがあります。

四つ目は障害時の代替手段です。特定のAIサービスや特定の人格設定に業務を依存しすぎると、仕様変更やモデル更新で出力が変わったときに対応できません。重要な業務では、標準プロンプト、別モデル、手動テンプレートのいずれかを代替手段として残しておくと安心です。

試験導入から本格導入までの見方

試験導入では、まず10件から30件程度の実タスクを使い、出力を人間が評価するのが現実的です。評価軸は、正確性、文体の一貫性、余計な比喩の有無、禁止表現、修正にかかる時間などに分けます。単に「良さそう」ではなく、修正時間が減ったかどうかを見ると導入効果を判断しやすくなります。

本格導入を急がなくてよいケースもあります。たとえば、月に数本しか文書を作らない、レビュー担当者が少ない、公開前チェックの体制がない、モデル更新時の再検証ができない場合です。このような場合は、まず通常のカスタムプロンプトやテンプレート運用から始め、効果が見えた段階でスタイル機能を広げるほうが安全です。

よくある質問

ChatGPTのゴブリン問題はバグですか?

一般的な意味での単純なバグというより、学習時の報酬設計と出力スタイルの副作用と見るほうが正確です。OpenAIの説明では、Nerdy人格向けに遊び心ある応答を評価する過程で、ゴブリンやグレムリンのような特定語彙を含む出力が高く評価され、後続の学習にも影響したとされています。つまり、コードの一行ミスではなく、AIの振る舞いを調整する仕組み全体の問題です。

日本語のChatGPTでもゴブリン問題は関係ありますか?

OpenAIが具体的に示した数値は主に英語圏の「goblin」「gremlin」に関するものですが、日本語ユーザーにも無関係ではありません。問題の本質は、特定の言語ではなく、AIが学習した文体や比喩の癖が意図しない場面で出ることにあります。日本語でも、過剰にくだけた表現、妙な比喩、定型句の連発などが業務文書に混ざる可能性はあります。

Nerdy人格はもう使えないのですか?

OpenAIのリリースノートでは、プリセットのNerdy基本スタイルを終了し、選択していたユーザーを既定の人格に移行すると説明されています。ただし、ChatGPTのPersonalizationでは、別の基本スタイルや詳細な好みの調整は引き続き利用できます。Nerdyそのものは終了しましたが、専門的、親しみやすい、簡潔といった方向性の調整は今後も重要な機能として残ると考えられます。

Codexで問題になったのはなぜですか?

Codexは開発支援やコード生成に使われるため、通常の雑談よりも余計な比喩や冗談が目立ちやすい領域です。コードレビュー、コミット説明、エラー原因の説明に不自然な言葉が混ざると、開発者は内容よりも表現に気を取られます。OpenAIは、GPT-5.5の訓練が根本原因の特定前に始まっていたため、Codexでは開発者向けプロンプトで抑制する対応を加えたと説明しています。

ClaudeやGeminiなら同じ問題は起きないのですか?

ClaudeやGeminiにも、スタイルやカスタムAIを作る機能があります。ClaudeはStylesで応答スタイルを切り替えられ、GeminiはGemsで繰り返し使う詳細な指示を保存できます。ただし、どのAIでも、カスタマイズが強くなるほど出力の一貫性や禁止表現の確認が重要になります。今回と同じ形で起きるとは限りませんが、スタイル制御の監査はどのサービスでも必要です。

企業がAIの性格設定を使うとき、何をチェックすべきですか?

まず、業務ごとの許容トーンを決めることが重要です。顧客対応、社内FAQ、技術文書、SNS投稿では、望ましい文体が異なります。次に、サンプル出力を複数回テストし、正確性だけでなく、余計な比喩、過度な親しみ、断定しすぎる表現、禁止語の有無を確認します。モデル更新後に再検証する手順も用意しておくと、予期しない変化に対応しやすくなります。

まとめ:ゴブリン問題はAIの「話し方」を制御する難しさを示している

ChatGPTのゴブリン問題は、表面的には奇妙で笑える出来事です。しかし中身を見ると、AIの性格付け、強化学習、訓練データ、プロンプトによる抑制、エージェント用途での信頼性が絡んだ重要な事例です。OpenAIが公式に原因を説明したことで、AIの出力スタイルがどのように作られ、どのように崩れるのかを考える材料になりました。

今後、AIは単なる質問応答ツールではなく、文書作成、開発支援、顧客対応、社内ワークフローの中に深く入っていきます。そのとき重要になるのは、モデルの賢さだけではありません。どのような口調で、どの範囲まで自動化し、どのタイミングで人間が確認するのか。今回のゴブリン問題は、その設計を見直すきっかけになります。

コメント