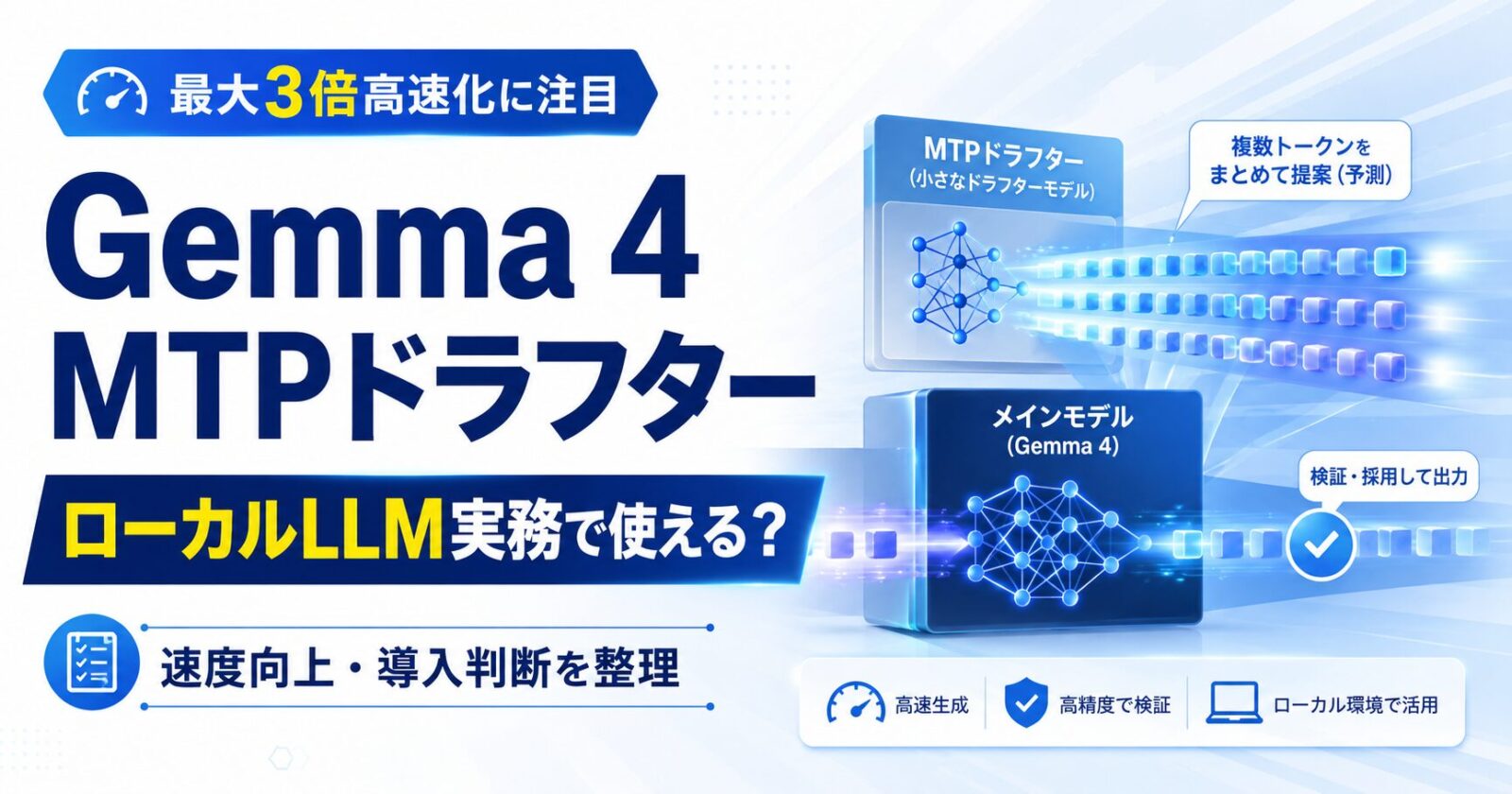

GoogleがGemma 4向けに公開したMTPドラフターは、ローカルLLMの体感速度を大きく変える可能性がある高速化用チェックポイントです。ただし、「最大3倍速い」という数字だけで導入を決めるのは早計です。実務では、どのモデルを使うか、どのランタイムで動かすか、追加メモリを許容できるかによって効果が変わります。本記事では、Gemma 4 MTPドラフターの仕組みと導入判断を整理します。

まず結論:Gemma 4 MTPドラフターは「速いGemma」ではなく、Gemma 4を速く使うための補助モデル

Gemma 4 MTPドラフターは、Gemma 4本体を置き換える新しい会話モデルではありません。Googleが2026年5月5日に発表した、Gemma 4ファミリー向けのMulti-Token Prediction、つまり複数トークン先読み用のドラフトモデルです。公式発表では、投機的デコーディングの仕組みにより、Gemma 4の推論を最大3倍高速化できると説明されています。

ポイントは、生成結果を最終的に決めるのはGemma 4本体であり、MTPドラフターは「次に来そうなトークン列」を先に提案する役割に徹することです。Gemma 4本体がその提案をまとめて検証し、受け入れられる部分だけを採用します。Googleはこの仕組みにより、出力品質や推論ロジックを落とさずに高速化できると説明しています。

ただし、実務導入では「必ず3倍速くなる」と読むべきではありません。速度改善は、ドラフトされたトークンがどれだけ受理されるか、GPUやApple Siliconなどのハードウェア特性、バッチサイズ、ランタイムのMTP対応状況に左右されます。特にローカルLLMで使う場合は、速度だけでなく、メモリ使用量、モデルロード時間、既存ツールとの接続性も確認が必要です。

何が発表されたのか:Gemma 4向けのMTPドラフターが公開

Googleは公式ブログ「Accelerating Gemma 4: faster inference with multi-token prediction drafters」で、Gemma 4ファミリー向けのMTPドラフターを公開したと発表しました。発表日は2026年5月5日です。

Gemma 4は、Google DeepMindが公開しているオープンモデルファミリーです。公式ページでは、E2B、E4B、26B MoE、31B Denseといったサイズが示され、モバイル、エッジデバイス、開発者ワークステーション、クラウドまで幅広い実行環境を想定しています。詳しくはGemma 4公式ページとGemma 4発表ブログで確認できます。

MTPドラフターは、Gemma 4本体とペアで使う軽量な補助モデルです。GoogleのMTPドキュメントでは、たとえばHugging Face TransformersでGemma 4本体をtarget model、対応する「-assistant」モデルをdrafterとして読み込み、generate関数にassistant_modelを渡す形で利用する例が示されています。実装の入口はGemma 4 MTP概要ドキュメントとHugging Face TransformersでのMTP利用手順です。

公開されているassistantモデルは、Gemma 4の各ターゲットモデルに対応する形で用意されています。Hugging Face上では、google/gemma-4-E2B-it-assistant、google/gemma-4-E4B-it-assistant、google/gemma-4-26B-A4B-it-assistant、google/gemma-4-31B-it-assistantといった名称で確認できます。ライセンスはGemma 4本体と同じApache 2.0とされています。

背景:なぜLLM推論の高速化が重要なのか

大規模言語モデルの推論は、1トークンずつ順番に生成する自己回帰型の処理が基本です。次の単語や記号を1つ出し、その結果を入力に戻してまた次を出すため、長い文章やコードを生成するほど待ち時間が積み上がります。チャットで数秒待つだけなら許容できても、IDE補完、音声応答、ブラウザ操作エージェント、社内ワークフロー自動化では、数百ミリ秒単位の遅延が体験を左右します。

特にローカルLLMでは、モデルの重みをGPUメモリや共有メモリから読み出すコストが大きくなります。Googleの説明でも、標準的なLLM推論はメモリ帯域に制約されやすく、プロセッサの計算能力を十分に使い切れないことがレイテンシの原因になるとされています。つまり、単純にGPUを積めば必ず応答が快適になるわけではありません。

この課題に対して、以前から使われてきたのが投機的デコーディングです。小さく速いドラフトモデルが先に複数トークンを提案し、大きなターゲットモデルがそれを一括で検証します。提案が当たっていれば複数トークンをまとめて進められ、外れてもターゲットモデルが正しいトークンを出すため、品質を保ちながら逐次生成の回数を減らせます。

Gemma 4 MTPドラフターは、この投機的デコーディングをGemma 4向けに最適化した仕組みです。一般的なドラフトモデルを別に探して組み合わせるのではなく、Gemma 4本体の入力埋め込みや最終層の活性化、KVキャッシュを活用する設計になっている点が特徴です。

Gemma 4 MTPドラフターで何ができるようになるのか

従来のGemma 4でも、ローカル環境でチャット、コード生成、構造化出力、エージェント処理を行うことは可能でした。MTPドラフターによって変わるのは、主に「同じモデルをより低レイテンシで使える可能性が高まる」ことです。新しい知識や能力を足すというより、既存の能力をより速く返すための仕組みだと理解すると分かりやすいでしょう。

たとえば、ローカルIDEでコード補完を行う場合、ユーザーは短い待ち時間に敏感です。1回の補完が数秒かかると作業の流れが切れますが、MTPドラフターでトークン生成が速くなれば、補完候補や短い説明をより自然なテンポで返せる可能性があります。Gemma 4 26Bや31Bのような大きめのモデルでは、品質を保ちながら体感速度を改善できるなら実務価値は大きくなります。

社内エージェントでも利点があります。エージェントは、ユーザーへの最終回答だけでなく、計画、ツール呼び出し、結果の要約、次アクションの判断など、複数ステップでLLMを呼び出します。各ステップの生成が少しずつ速くなると、全体の待ち時間が短くなります。Google Cloud公式ブログでも、Gemma 4は推論、関数呼び出し、コード生成、構造化出力などのエージェント機能に触れられており、こうした用途との相性が見込まれます。

オンデバイス用途でも、E2BやE4Bのような軽量モデルと組み合わせることで、スマートフォン、ノートPC、エッジデバイス上の応答性を改善できる可能性があります。Googleは公式発表で、エッジからワークステーションまでの低レイテンシ用途を想定しており、モバイルアプリや完全オンデバイス実行の応答速度改善にも言及しています。

一方で、MTPドラフターは「できなかった推論をできるようにする」技術ではありません。たとえば、Gemma 4本体が苦手な専門領域をドラフターだけで補ったり、長文理解力を根本的に引き上げたりするものではありません。新しい能力追加ではなく、推論経路の効率化と捉えることが大切です。

既存競合との比較:標準推論、従来型投機的デコーディング、クラウドAPIとどう違うか

| 比較対象 | 主な特徴 | 強み | 注意点 | 向いているケース |

|---|---|---|---|---|

| Gemma 4の標準自己回帰推論 | Gemma 4本体だけで1トークンずつ生成する | 構成が単純で検証しやすい。追加モデルが不要 | 長文生成やエージェント処理では待ち時間が伸びやすい | まず安定動作を確認したいPoC、短文応答、検証初期 |

| Gemma 4 MTPドラフター | Gemma 4本体に対応するassistantモデルが複数トークンを先読みする | Gemma 4向けに設計され、入力埋め込みや活性化、KVキャッシュを活用できる | 効果は受理率、バッチサイズ、ハードウェア、ランタイム対応に依存する | ローカルLLMの応答速度を改善したいIDE補完、社内エージェント、オンデバイスAI |

| 従来型の投機的デコーディング | 小型のドラフトモデルと大型のターゲットモデルを組み合わせる | vLLMやllama.cppなどでも広く扱われる考え方で、応用範囲が広い | 互換性のあるドラフトモデル選び、同一トークナイザー、追加メモリの確認が必要 | Gemma以外のモデルでも高速化を試したい環境 |

| 量子化・バッチング・高速サービング | モデル重みの圧縮、リクエスト集約、サービングエンジン最適化で高速化する | メモリ削減や同時処理数の改善に効きやすい | 量子化では精度差、バッチングでは単発応答の遅延、運用設計の複雑化が起きる | 多数ユーザー向けAPI、サーバー運用、コスト最適化 |

| GeminiなどのクラウドAPI | ローカルではなく外部APIとして高性能モデルを使う | モデル運用やGPU管理が不要で、最新機能を使いやすい | データ送信、利用料金、レイテンシ、ベンダーロックインの検討が必要 | インフラを持たずに高性能AIをすぐ使いたい組織 |

比較すると、Gemma 4 MTPドラフターの強みは「Gemma 4をローカルまたは自社管理環境で使いたいが、標準推論の遅さが課題」という場面にあります。クラウドAPIの代替というより、オープンモデルを自前環境で使う際の実用性を高める技術です。

従来型の投機的デコーディングとの違いは、Gemma 4向けに作られたassistantモデルが用意されていることです。vLLMのSpeculative Decodingドキュメントやllama.cppのspeculative decodingドキュメントでも、小さなドラフトモデルを使って推論を高速化する発想は確認できます。ただし、Gemma 4 MTPでは、対象モデルとの組み合わせが公式に整理されているため、Gemma 4利用者にとって試しやすい形になっています。

価格面では、MTPドラフター自体がGemma 4本体と同じApache 2.0ライセンスで提供される点は導入しやすい材料です。ただし、ローカルで動かす場合もGPU、電力、メモリ、保守工数は必要です。クラウドAPIと比較するなら、モデル利用料だけでなく、担当者の運用負担や障害時対応まで含めて見る必要があります。

懸念点・注意点:最大3倍速だけを見て導入すると失敗しやすい

最初の注意点は、速度改善が環境依存であることです。Googleは最大3倍の高速化を示していますが、これは特定のハードウェアやランタイムでの検証結果です。MTPはドラフトされたトークンが多く受理されるほど効果が出やすく、逆に受理率が低いタスクでは、ドラフトに使った計算が無駄になりやすくなります。

2つ目は、MoEモデルでの挙動です。GoogleのMTP概要では、Gemma 4 26B A4BのようなMixture of Expertsモデルでは、トークンごとに活性化する専門家が異なるため、追加の重み読み込みが発生し、バッチサイズ1では速度改善が出にくい場合があると説明されています。一方、バッチサイズが増えると活性化される専門家の重なりが増え、重み再利用によって改善しやすくなります。

3つ目は、追加メモリです。MTPドラフターは軽量とはいえ、Gemma 4本体に加えてassistantモデルもロードします。小型モデルでは影響が小さく見えても、GPUメモリがぎりぎりの環境では、量子化、KVキャッシュ、コンテキスト長、同時接続数と合わせて確認しなければなりません。

4つ目は、ランタイム対応です。Hugging Face Transformersではassistant_modelを渡す形のサンプルが公式に示されていますが、Ollama、LM Studio、MLX、vLLM、SGLang、llama.cpp系の環境では、Gemma 4本体の対応とMTPドラフターの対応を分けて確認する必要があります。単に「Gemma 4が動く」だけでは、MTPが有効になるとは限りません。

5つ目は、品質評価の見方です。投機的デコーディングでは本体モデルが検証するため、理論上は品質を保ちやすい仕組みです。ただし、実務ではサンプリング設定、量子化、プロンプト形式、チャットテンプレート、thinkingモードの扱いなどが結果に影響する可能性があります。導入時は、標準推論とMTP有効時の出力を同じプロンプトセットで比較し、速度だけでなく回答の安定性も見てください。

導入メリットを得やすい人・組織

向いているのは、ローカルLLMの遅延が業務体験を壊しているチーム

MTPドラフターが刺さりやすいのは、すでにGemma 4またはローカルLLMを試しており、「品質は悪くないが、応答が遅くて使い続けにくい」と感じているチームです。たとえば、社内文書の要約、コードレビュー補助、ローカルIDE補完、軽量な社内エージェントなどでは、推論速度の改善がそのまま利用頻度に影響します。

特に、外部APIに送れないデータを扱う組織には検討価値があります。顧客情報、開発中コード、未公開資料、研究データなどを外部に出したくない場合、ローカルまたは自社クラウドでオープンモデルを動かす選択肢が重要になります。MTPドラフターは、その際の「自前運用はできるが遅い」というボトルネックを緩和する可能性があります。

また、エージェント型ワークフローを試す開発者にも向いています。1回の回答だけでなく、計画、検索、ツール呼び出し、コード生成、検証を何度も繰り返す処理では、各ステップの数秒差が積み上がります。MTPによって1ステップごとの生成が速くなるなら、エージェント全体の待ち時間を短縮しやすくなります。

現時点では向いていないのは、標準推論の速度を測っていないチーム

逆に、まだGemma 4本体の標準推論を測っていない段階で、いきなりMTPを本番導入するのはおすすめしません。まずは本体モデルだけで、必要な回答品質、必要なコンテキスト長、1リクエストあたりの生成トークン数、同時接続数、GPUメモリ使用量を確認すべきです。ボトルネックが推論速度ではなく、プロンプト設計やRAG検索、ツール呼び出しにある場合、MTPだけでは効果が限定的です。

また、バッチサイズ1の単発チャットを低スペック環境で少しだけ使う用途では、期待ほど速度が出ない可能性があります。特にMoEモデルでは、ハードウェアやバッチサイズの影響を受けます。ローカルLLMを趣味的に試すだけなら、まずは量子化済みモデルや軽量モデルの選定を優先した方が効果を感じやすいケースもあります。

クラウドAPIで十分に低遅延・低コストに運用できている組織も、無理に移行する必要はありません。MTPドラフターは魅力的ですが、ローカル運用にはGPU管理、セキュリティ更新、監視、障害対応が伴います。データ主権やオフライン実行が重要でない場合は、クラウドAPIの方が総コストを抑えられることがあります。

実務導入を判断する際のポイント

まず確認したい前提条件

最初に確認すべきなのは、Gemma 4を選ぶ理由です。外部APIを使えない、応答データを自社環境に閉じたい、ローカルIDEやオンデバイスで動かしたい、モデルの重みを直接扱いたいといった理由があるなら、Gemma 4とMTPドラフターの検討価値は高まります。一方、単に「新しいから試したい」だけなら、標準推論との比較検証で止めるのが現実的です。

次に、どのGemma 4モデルを使うかを決めます。E2BやE4Bはエッジや軽量環境向け、26B MoEや31B Denseはより高い推論能力を狙う環境向けです。MTPドラフターは対応する本体モデルと組み合わせる必要があるため、モデル選定と高速化検証はセットで考える必要があります。

導入判断で見るべきポイント

1つ目は、速度です。平均tokens per secondだけでなく、最初のトークンまでの時間、全文生成完了までの時間、エージェント1タスク完了までの時間を測ると実務に近い判断ができます。短文チャットで速く見えても、長文要約やコード生成で同じ効果が出るとは限りません。

2つ目は、再現性です。MTP有効時と無効時で、同じプロンプトセットを複数回走らせ、出力のブレ、途中停止、テンプレート崩れ、JSON出力の安定性を確認します。構造化出力や関数呼び出しを使う場合は、自然文の見た目よりも、後続処理が壊れないかが重要です。

3つ目は、メモリとコストです。MTPドラフターは軽量ですが、ゼロコストではありません。Gemma 4本体、assistantモデル、KVキャッシュ、長いコンテキスト、同時リクエストを合算して、GPUメモリに余裕があるかを確認してください。メモリ不足でオフロードが増えると、MTPによる高速化を相殺することがあります。

4つ目は、既存システムとの接続性です。Hugging Face Transformersで検証するだけなら比較的始めやすい一方、本番ではvLLM、GKE、Cloud Run、独自APIサーバー、社内認証、ログ基盤、監視基盤と接続する必要があります。Google Cloudでは、Gemma 4のGKE、Cloud Run、Vertex AI、TPU利用などの情報も公開されているため、クラウド運用を前提にする場合はGoogle Cloud公式ブログも確認しておくとよいでしょう。

5つ目は、障害時の代替手段です。MTPを有効にした構成が不安定になった場合、本体モデルだけの標準推論に戻せる設計にしておくべきです。速度改善のために構成を複雑にしすぎると、障害時に原因を切り分けにくくなります。

試験導入から本格導入までの見方

試験導入では、まずGemma 4本体だけで基準値を作ります。次に同じプロンプト、同じ生成設定、同じハードウェアでMTPドラフターを有効にし、速度、メモリ、出力の差を測ります。このとき、短文、長文、コード生成、JSON出力、ツール呼び出し前提のプロンプトなど、実際の業務に近いセットを用意することが重要です。

本格導入を検討する段階では、MTPによる速度改善がユーザー体験や処理コストにどれだけ効くかを見ます。たとえば、1回答あたりの待ち時間が8秒から5秒になるだけでも、チャットUIでは大きな改善です。一方、夜間バッチ処理のようにリアルタイム性が低い用途では、MTPよりも量子化やバッチング、ジョブ設計の方が重要になる場合があります。

導入を急がなくてよいケース

導入を急がなくてよいのは、Gemma 4本体の品質評価が終わっていないケース、現行APIの遅延に不満がないケース、GPUメモリに余裕がないケース、ランタイムのMTP対応が不明なケースです。また、社内でLLMの監視や安全性評価の体制が整っていない場合も、速度改善より先にガバナンスを整えるべきです。

MTPドラフターは有望な高速化技術ですが、魔法のスイッチではありません。実務では「どれだけ速くなるか」よりも、「その速さが業務成果に変わるか」を見る必要があります。

よくある質問

Gemma 4 MTPドラフターとは何ですか?

Gemma 4 MTPドラフターは、Gemma 4本体と組み合わせて使う高速化用の補助モデルです。小さなassistantモデルが複数トークンを先読みし、Gemma 4本体がその候補を並列に検証します。新しい能力を追加するモデルではなく、Gemma 4の推論を低レイテンシにするための仕組みです。

Gemma 4 MTPドラフターを使うと本当に3倍速くなりますか?

Googleは公式発表で最大3倍の高速化を示していますが、すべての環境で同じ効果が出るわけではありません。ドラフト候補の受理率、モデルサイズ、GPUやApple Siliconなどのハードウェア、バッチサイズ、ランタイム実装によって変わります。実務では、自分のプロンプトと環境で標準推論と比較することが不可欠です。

出力品質は落ちませんか?

仕組み上、最終的な検証はGemma 4本体が行うため、Googleは標準的な自己回帰生成と同等の品質を保てると説明しています。ただし、量子化、サンプリング設定、チャットテンプレート、ランタイム差分が結果に影響する可能性はあります。導入前には、同じ評価セットでMTP有効時と無効時の出力を比較してください。

Hugging Face Transformersではどう使いますか?

公式ドキュメントでは、Gemma 4本体をtarget model、対応する「-assistant」モデルをdrafterとして読み込み、generate関数にassistant_modelを渡す例が示されています。たとえばgoogle/gemma-4-E2B-itに対してgoogle/gemma-4-E2B-it-assistantを組み合わせます。まずはColabや検証環境で動作確認するのが安全です。

OllamaやLM StudioでもMTPドラフターは使えますか?

Gemma 4本体がOllamaやLM Studioで扱えることと、MTPドラフターが有効に使えることは別です。MTPはランタイム側の対応が必要になるため、利用するツールのバージョン、モデル形式、assistantモデルの読み込み方法を確認してください。記事執筆時点では、まず公式ドキュメントが示すTransformersでの検証が最も確実です。

ローカルLLMを使うならMTPドラフターは必須ですか?

必須ではありません。短文応答、低頻度利用、速度より安定性を重視するPoCでは、まず標準推論だけで十分です。MTPドラフターが有効なのは、Gemma 4本体の品質には満足しているが、応答速度が業務利用の障害になっている場合です。導入判断では、速度改善が実際の利用率や処理コストに効くかを見てください。

まとめ:MTPドラフターはGemma 4を実務に近づけるが、検証なしの導入は避けたい

Gemma 4 MTPドラフターは、ローカルLLMや自社管理環境でGemma 4を使いたい開発者にとって、かなり重要な高速化技術です。複数トークンを先読みし、本体モデルがまとめて検証することで、標準的な1トークンずつの生成よりも応答性を改善できる可能性があります。

特に、IDE補完、社内エージェント、オンデバイスAI、外部APIに出せないデータを扱う業務では、速度改善の価値が出やすいでしょう。一方、効果は受理率、ハードウェア、バッチサイズ、ランタイム対応、メモリ余力に大きく依存します。最大3倍という数字だけで判断せず、自分の環境で標準推論との比較を行うべきです。

実務導入では、まずGemma 4本体の品質と速度を測り、次にMTP有効時の差分を確認するのが安全です。速度、再現性、メモリ、既存システムとの接続性、障害時の戻し方まで見たうえで、MTPドラフターを本番構成に入れるかを判断しましょう。

参考ソース

- Google Blog: Accelerating Gemma 4: faster inference with multi-token prediction drafters

- Google AI for Developers: Speed-up Gemma 4 with Multi-Token Prediction

- Google AI for Developers: Gemma 4 Multi-Token Prediction using Hugging Face Transformers

- Google DeepMind: Gemma 4

- Google Blog: Gemma 4: Our most capable open models to date

- Google Cloud公式ブログ: Google Cloudで利用できるGemma 4の概要

- vLLM Docs: Speculative Decoding

- llama.cpp Docs: Speculative decoding

- Hugging Face: google/gemma-4-E2B-it-assistant

コメント